コーディングエージェントとの統合

ベータ版

この機能はベータ版です。アカウント管理者は、アカウント コンソールの [プレビュー] ページからこの機能へのアクセスを制御できます。 「Databricks プレビューの管理」を参照してください。

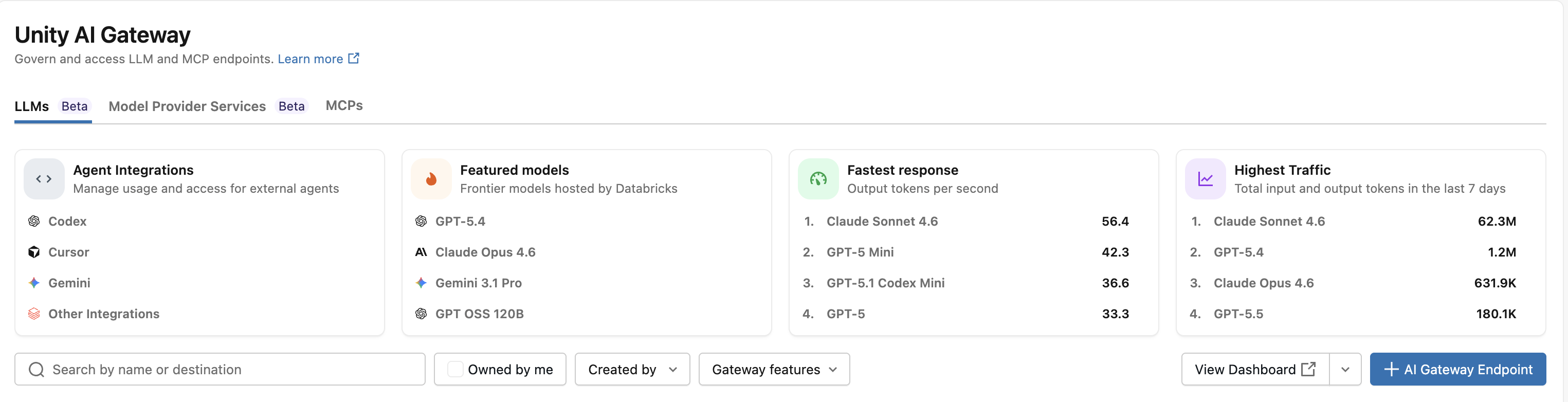

Databricks コーディングエージェントの統合により、Cursor、Gemini CLI、Codex CLI などのコーディングエージェントからのトラフィックを Unity AI Gateway エンドポイント経由でルーティングできます。これにより、レート制限、使用状況の追跡、および推論テーブルが提供されます。すべてのコントロールは、エンドポイント、ユーザー、またはグループレベルで設定されます。

特徴

- アクセス : 1 つの請求書で、さまざまなコーディング ツールとモデルに直接アクセスできます。

- 可観測性 : すべてのコーディング ツールの使用状況、支出、メトリクスを追跡するための単一の統合ダッシュボード。

- 統合ガバナンス :管理者は、Unity AI Gateway を介して、エンドポイント、ユーザー、またはグループのレベルで、モデルのアクセス許可とレート制限を管理できます。

要件

- お客様のアカウントでUnity AI Gatewayのプレビュー版が有効になりました。Databricksのプレビューを管理するを参照してください。

- Unity AI Gateway がサポートされるリージョン内のDatabricksワークスペース。

- ワークスペースで Unity Catalog が有効になりました。「Unity Catalog のワークスペースを有効にする」を参照してください。

設定

最も早く始める方法は、Databricks の CLI であるucodeを使用することです。これは、サポートされているコーディング エージェントを Unity AI Gateway にインストール、認証、構成するコマンドを 1 つ実行します。

ucodeを使用する(推奨)

ucode (Unity AI Gateway Coding CLI) は、Unity AI Gateway に対してコーディングエージェントを実行するための唯一のエントリポイントです。OAuthを処理し、各エージェントの設定ファイルを書き込み、登録済みのLLMまたはMCPサーバーを経由してトラフィックをルーティングします。サポートされているエージェント:

ステップ 1: ucode をインストールする

uv tool install git+https://github.com/databricks/ucode

Python 3.12以降とuvが必要です。

ステップ 2: コーディング エージェントを開く

実行したいエージェントを実行してください。最初の起動時に、 ucode Databricksワークスペース URL の入力を求め、認証し、エージェントの構成ファイルを自動的に書き込みます。 その後の発売はすべて代理店に直接送られる。

ucode codex # OpenAI Codex

ucode gemini # Gemini CLI

ucode opencode # OpenCode

ucode copilot # GitHub Copilot CLI

ucode pi # Pi

ucode エージェント名の後にフラグを渡すことで、基盤となるツールに渡されます。例:

ucode codex --full-auto

複数のコーディングエージェントを同時に設定するには、以下を実行します。

ucode configure

Databricks MCPサーバー(Unity Catalog関数、AI検索、SQLウェアハウス、および検出された外部接続)をMCP対応エージェントに登録するには:

ucode configure mcp

過去7日間のUnity AI Gatewayの使用状況概要を確認するには:

ucode usage

コマンドの完全なリファレンスについては、以下を実行してください。

ucode --help

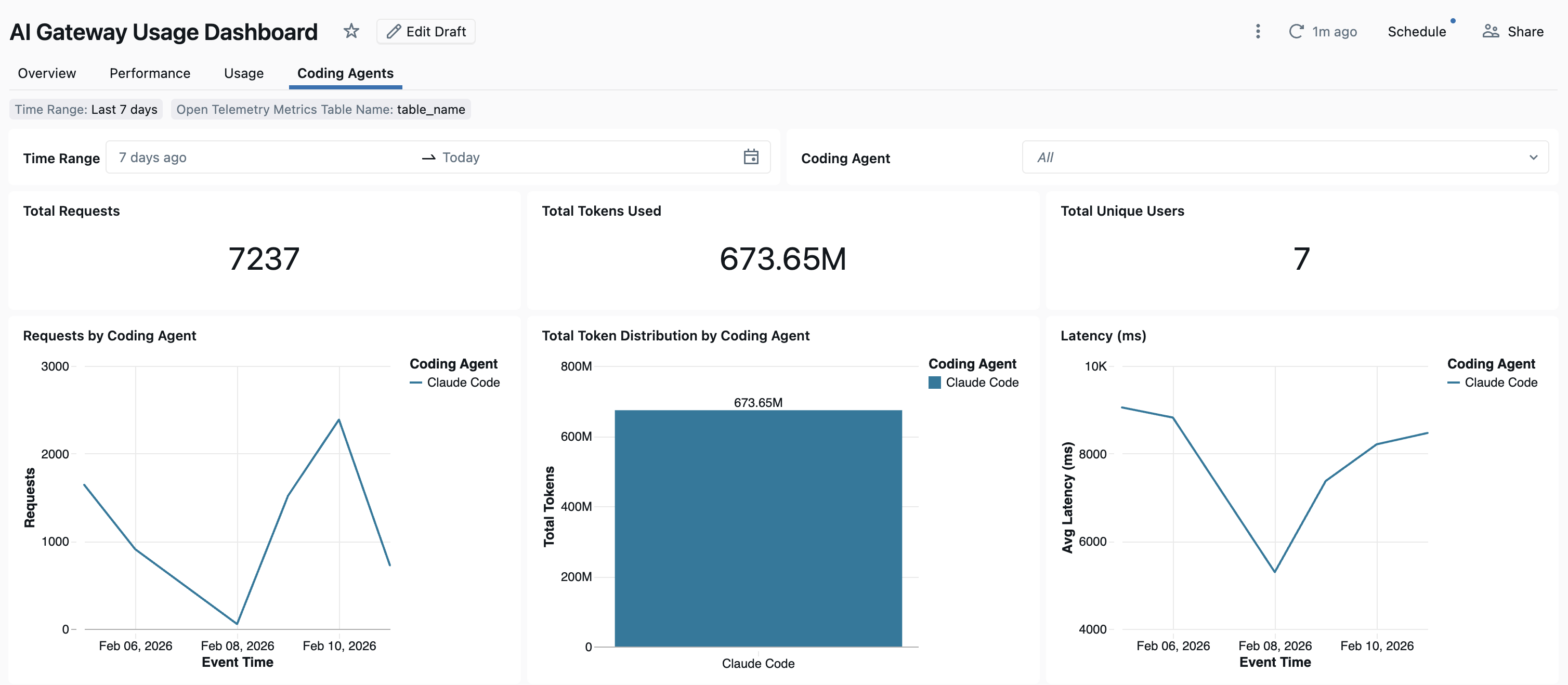

ダッシュボード

コーディング エージェントの使用状況が Unity AI Gateway を通じて追跡された後、組み込みダッシュボードでメトリクスを表示および監視できます。

ダッシュボードを開くには、AIゲートウェイページから 「ダッシュボードを表示」 を選択してください。この操作により、コーディングツールの使用状況を示すグラフを含む、事前設定済みのダッシュボードが作成されます。

手動設定

エージェントを自分で設定する場合は、以下の手順に従ってください。

カーソルIDE

CursorでUnity AI Gatewayエンドポイントを使用するように設定するには:

ステップ 1: ベース URL とAPIキーを構成する

-

Cursor を開き、 [設定] > [カーソル設定] > [モデル] > [API キー] に移動します。

-

OpenAI ベース URL のオーバーライドを 有効にして、URL を入力します。

https://<workspace-url>/ai-gateway/cursor/v1<workspace-url>を Databricks ワークスペースの URL に置き換えます。 -

Databricksの個人アクセスを OpenAI APIキー フィールドに貼り付けます。

ステップ 2: カスタムモデルを追加する

- カーソル設定で + カスタム モデルの追加を クリックします。

- Unity AI Gatewayのエンドポイント名を追加し、トグルを有効にしてください。

現在、Databricks によって作成された基盤モデル エンドポイントのみがサポートされています。

ステップ 3: 統合をテストする

Cmd+L(macOS) またはCtrl+L(Windows/Linux) で Ask モードを開き、モデルを選択します。- メッセージを送信してください。すべてのリクエストがDatabricksを経由するようになりました。

コーデックス CLI

ステップ 1: Codex CLIをインストールまたは更新する

Codex CLI バージョン 0.118 以降をインストールまたはアップデートしてください。

npm install -g @openai/codex@latest

ステップ2:Codex設定ファイルを作成または更新

~/.codex/config.tomlで Codex 構成ファイルを作成または編集します:

profile = "default"

[profiles.default]

model_provider = "Databricks"

[model_providers.Databricks]

name = "Databricks :re[ai-gateway]"

base_url = "<workspace-url>/ai-gateway/codex/v1"

wire_api = "responses"

[model_providers.Databricks.auth]

command = "sh"

args = ["-c", "databricks auth token --host <workspace-url> --output json | jq -r '.access_token'"]

timeout_ms = 5000

refresh_interval_ms = 1800000

<workspace-url> を Databricks ワークスペースの URL に置き換えます。

ステップ 3: ワークスペースに対して認証する

これは一度だけ行えばよい。Codexを起動するたびに再認証する必要はありません。

まず、Databricks CLIがインストールされていることを確認してください。手順については、「Databricks CLI のインストールまたはアップデート」を参照してください。

次に認証します。

databricks auth login --host <workspace-url>

<workspace-url> を Databricks ワークスペースの URL に置き換えます。

ステップ 4: Codex を開始する

codex

モデルを変更するには、 /modelを使用します。

ジェミニCLI

ステップ 1: Gemini CLIの最新バージョンをインストールする

npm install -g @google/gemini-cli@nightly

ステップ 2: 環境変数を設定する

ファイル~/.gemini/.envを作成し、次の構成を追加します。詳細については、 Gemini CLI 認証ドキュメントを参照してください。

GEMINI_MODEL=databricks-gemini-2-5-flash

GOOGLE_GEMINI_BASE_URL=https://<workspace-url>/ai-gateway/gemini

GEMINI_API_KEY_AUTH_MECHANISM="bearer"

GEMINI_API_KEY=<databricks_pat_token>

<workspace-url> Databricksワークスペースの URL に置き換え、 <databricks_pat_token>個人のアクセス場所に置き換えます。

OpenTelemetryデータ収集を設定する

Databricks 、コーディング エージェントからUnity Catalogで管理されるDeltaテーブルへの OpenTelemetry メトリックとログのエクスポートをサポートしています。 すべてのメトリクスは、OpenTelemetry 標準メトリクス プロトコルを使用してエクスポートされた時系列データであり、ログは OpenTelemetry ログ プロトコルを使用してエクスポートされます。

要件

- Databricks プレビューの OpenTelemetry が有効になりました。「Databricks プレビューの管理」を参照してください。

ステップ 1: Unity Catalogで OpenTelemetry テーブルを作成する

OpenTelemetry メトリクスおよびログ スキーマで事前設定されたUnity Catalogマネージドテーブルを作成します。

メトリクステーブル

CREATE TABLE <catalog>.<schema>.<table_prefix>_otel_metrics (

name STRING,

description STRING,

unit STRING,

metric_type STRING,

gauge STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

value: DOUBLE,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

attributes: MAP<STRING, STRING>,

flags: INT

>,

sum STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

value: DOUBLE,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

attributes: MAP<STRING, STRING>,

flags: INT,

aggregation_temporality: STRING,

is_monotonic: BOOLEAN

>,

histogram STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

count: LONG,

sum: DOUBLE,

bucket_counts: ARRAY<LONG>,

explicit_bounds: ARRAY<DOUBLE>,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

attributes: MAP<STRING, STRING>,

flags: INT,

min: DOUBLE,

max: DOUBLE,

aggregation_temporality: STRING

>,

exponential_histogram STRUCT<

attributes: MAP<STRING, STRING>,

start_time_unix_nano: LONG,

time_unix_nano: LONG,

count: LONG,

sum: DOUBLE,

scale: INT,

zero_count: LONG,

positive_bucket: STRUCT<

offset: INT,

bucket_counts: ARRAY<LONG>

>,

negative_bucket: STRUCT<

offset: INT,

bucket_counts: ARRAY<LONG>

>,

flags: INT,

exemplars: ARRAY<STRUCT<

time_unix_nano: LONG,

value: DOUBLE,

span_id: STRING,

trace_id: STRING,

filtered_attributes: MAP<STRING, STRING>

>>,

min: DOUBLE,

max: DOUBLE,

zero_threshold: DOUBLE,

aggregation_temporality: STRING

>,

summary STRUCT<

start_time_unix_nano: LONG,

time_unix_nano: LONG,

count: LONG,

sum: DOUBLE,

quantile_values: ARRAY<STRUCT<

quantile: DOUBLE,

value: DOUBLE

>>,

attributes: MAP<STRING, STRING>,

flags: INT

>,

metadata MAP<STRING, STRING>,

resource STRUCT<

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

resource_schema_url STRING,

instrumentation_scope STRUCT<

name: STRING,

version: STRING,

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

metric_schema_url STRING

) USING DELTA

TBLPROPERTIES (

'otel.schemaVersion' = 'v1'

)

ログテーブル

CREATE TABLE <catalog>.<schema>.<table_prefix>_otel_logs (

event_name STRING,

trace_id STRING,

span_id STRING,

time_unix_nano LONG,

observed_time_unix_nano LONG,

severity_number STRING,

severity_text STRING,

body STRING,

attributes MAP<STRING, STRING>,

dropped_attributes_count INT,

flags INT,

resource STRUCT<

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

resource_schema_url STRING,

instrumentation_scope STRUCT<

name: STRING,

version: STRING,

attributes: MAP<STRING, STRING>,

dropped_attributes_count: INT

>,

log_schema_url STRING

) USING DELTA

TBLPROPERTIES (

'otel.schemaVersion' = 'v1'

)

ステップ 2: コーディング エージェントの環境変数を更新する

OpenTelemetry メトリクス サポートが有効になっているコーディング エージェントで、次の環境変数を設定します。

{

"OTEL_METRICS_EXPORTER": "otlp",

"OTEL_EXPORTER_OTLP_METRICS_PROTOCOL": "http/protobuf",

"OTEL_EXPORTER_OTLP_METRICS_ENDPOINT": "https://<workspace-url>/api/2.0/otel/v1/metrics",

"OTEL_EXPORTER_OTLP_METRICS_HEADERS": "content-type=application/x-protobuf,Authorization=Bearer <databricks_pat_token>,X-Databricks-UC-Table-Name=<catalog>.<schema>.<table_prefix>_otel_metrics",

"OTEL_METRIC_EXPORT_INTERVAL": "10000",

"OTEL_LOGS_EXPORTER": "otlp",

"OTEL_EXPORTER_OTLP_LOGS_PROTOCOL": "http/protobuf",

"OTEL_EXPORTER_OTLP_LOGS_ENDPOINT": "https://<workspace-url>/api/2.0/otel/v1/logs",

"OTEL_EXPORTER_OTLP_LOGS_HEADERS": "content-type=application/x-protobuf,Authorization=Bearer <databricks_pat_token>,X-Databricks-UC-Table-Name=<catalog>.<schema>.<table_prefix>_otel_logs",

"OTEL_LOGS_EXPORT_INTERVAL": "5000"

}

ステップ 3: コーディング エージェントを実行します。

データは 5 分以内にUnity Catalogテーブルに伝播されるはずです。