エージェントおよびLLM向けのUnity AI Gateway

ベータ版

このページでは、現在ベータ版である新しいAIゲートウェイ(UIの左側のナビゲーションに表示されます)について説明します。アカウント管理者は、アカウント コンソールの [プレビュー] ページでこの機能へのアクセスを有効にすることができます。 Databricksのプレビューを管理するを参照してください。

Unity AI Gateway の以前のバージョンに関する詳細は、 「エンドポイントを提供する Unity AI Gateway」を参照してください。

Unity AI Gatewayは、AWS GovCloudまたはAzure Governmentではサポートされていません。

Unity AI Gatewayとは何ですか?

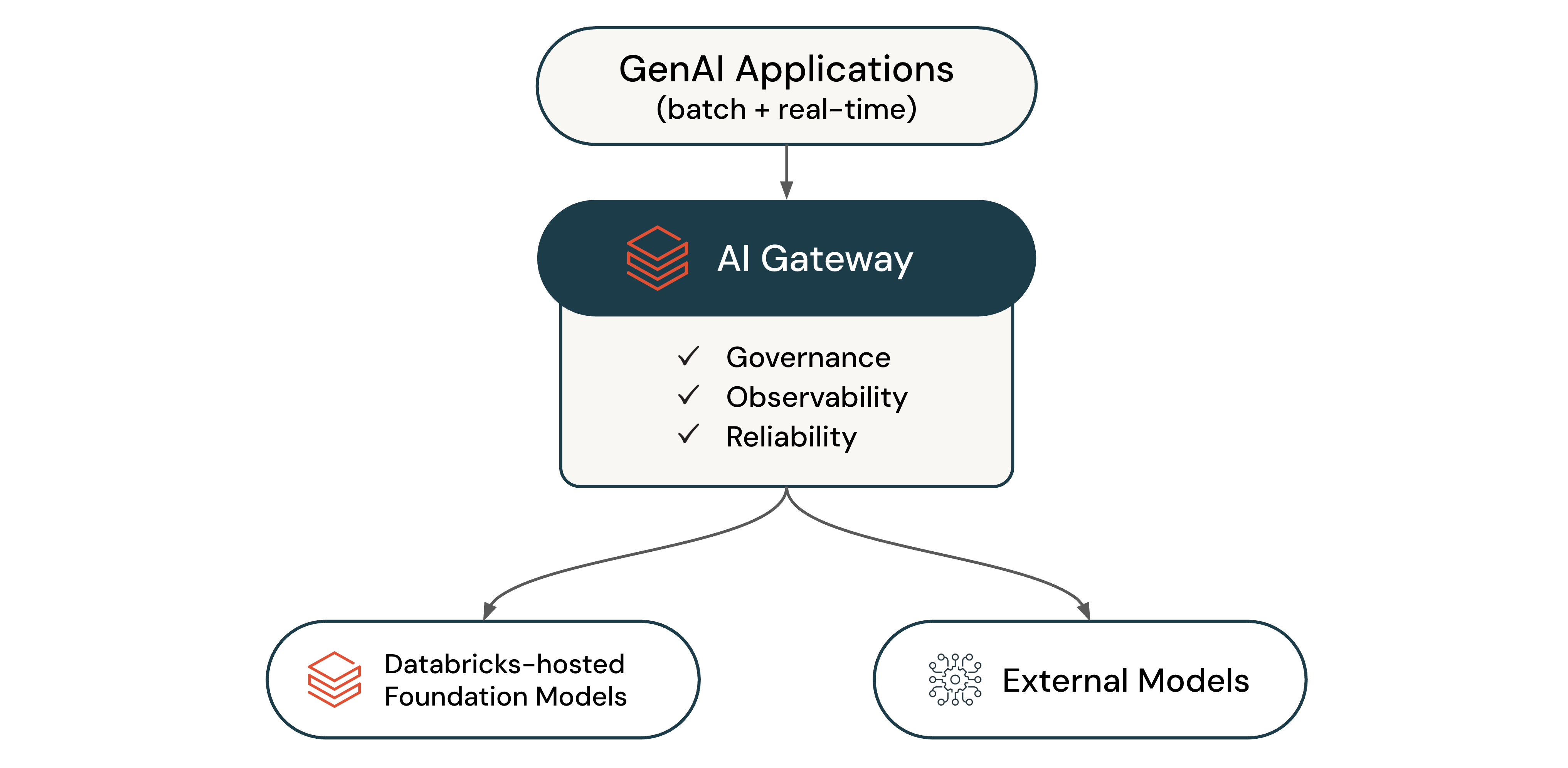

Unity AI Gatewayは、LLMエンドポイント、エージェント、およびコーディングツールを管理するためのエンタープライズ制御プレーンです。これを使用して、使用状況の分析、権限の設定、およびプロバイダー間の容量管理を行うことができます。

Unity AI Gateway を使用すると、次のことが可能になります。

- 組織内でLLM、エージェント、コーディングツールがどのように使用されているか を分析する

- Databricks でホストされているモデルと外部モデルへのアクセスを 管理する

- すべてのエンドポイントの LLM トラフィックを Unity Catalog に 記録します 。

- エンドポイントの健全性とプロバイダーの可用性 を監視する

- エンドポイント、ユーザー、またはグループレベルでレート制限とガードレールを適用します。

- コストを特定のエンドポイント、ユーザー、チームに 割り当てる

- 信頼性と負荷分散のために、プロバイダー間でトラフィックをインテリジェントに ルーティングします 。

- 拡張性を高めるために、トラフィックを複数のモデルバックエンドに 分散させる

- コードを変更せずにプロバイダーとモデル を切り替える

サポートされている機能

以下の表は、利用可能なUnity AI Gatewayの機能を示しています。

機能 | 説明 |

|---|---|

権限 | エンドポイントにアクセスできるユーザーを制御します。 |

システムテーブルを使用して使用状況とコストを監視します。 | |

Unity Catalog Delta テーブル内の要求と応答を監視および監査します。 | |

運用メトリクス | 使用状況をリアルタイムで監視します。 |

エンドポイント、ユーザー、またはグループ レベルで消費制限を適用します。 | |

コンテンツフィルタリング、機密データ保護、およびカスタムポリシーを適用します。 | |

料金利用システムテーブルと使用状況ダッシュボードで、Unity AI Gateway エンドポイント、宛先モデル、プリンシパル、タグのDatabricksコストを分析します。 | |

フォールバック | 障害が発生した場合に複数のプロバイダーにルーティングすることで信頼性を高めます。 |

交通分離 | スケーラビリティと負荷分散を向上させるため、トラフィックを複数のモデルバックエンドに分散させる。 |

カスタムAPIs | カスタムAPIおよび外部APIs 、 LLMエンドポイントと同じアクセス制御、レート制限、およびログ記録で管理します。 |

Unity AI Gatewayの機能は、ベータ版期間中は料金が発生しません。

Unity AI Gatewayを使用する

Databricksは、人気のあるLLM(論理言語管理)向けにUnity AI Gatewayのエンドポイントを提供しています。エージェント、コーディングツール、その他のアプリケーションを管理するための新しいエンドポイントを作成できます。

まずは、 「Unity AI Gatewayエンドポイントの設定」を参照してください。エンドポイントを照会するには、 「Unity AI Gateway エンドポイントの照会」を参照してください。Cursor、Gemini CLI、Codex CLI、Claude Codeなどのコーディングエージェントを統合するには、 「コーディングエージェントとの統合」を参照してください。Databricks Apps 上で作成およびデプロイしたエージェントからの LLM 呼び出しを Unity AI Gateway 経由でルーティングするには、ステップ 4「Unity AI Gateway を使用して Databricks Apps 上のエージェントからの LLM の使用を管理する」を参照してください。

クエリのクイックスタート

Genie Code (エージェントモード)に以下の操作を指示してください。

Create a new notebook that queries a :re[ai-gateway] endpoint using Python and the OpenAI client.

以下の例は、PythonとOpenAIクライアントを使用してUnity AI Gatewayエンドポイントにクエリを実行する方法を示しています。

from openai import OpenAI

import os

# To get a Databricks token, see https://docs.databricks.com/dev-tools/auth/pat

DATABRICKS_TOKEN = os.environ.get('DATABRICKS_TOKEN')

client = OpenAI(

api_key=DATABRICKS_TOKEN,

base_url="https://<workspace-url>/ai-gateway/mlflow/v1"

)

chat_completion = client.chat.completions.create(

messages=[

{"role": "user", "content": "Hello!"},

{"role": "assistant", "content": "Hello! How can I assist you today?"},

{"role": "user", "content": "What is Databricks?"},

],

model="databricks-gpt-5-2",

max_tokens=256

)

print(chat_completion.choices[0].message.content)

<workspace-url> を Databricks ワークスペースの URL に置き換えます。