OpenTelemetryのエクスポート

ベータ版

この機能はベータ版です。ワークスペース管理者は、 プレビュー ページからこの機能へのアクセスを制御できます。Databricksのプレビューを管理するを参照してください。

OpenTelemetry統合は、Lakebase Postgresの メトリクス と ログを、 OpenTelemetryプロトコル(OTLP)を使用してデータを受け入れる任意の宛先に送信します。Grafana クラウド、New Relic、Datadog OTLP インジェスト、Honeycomb、または別の OTLP 互換バックエンドを使用できます。

このページでは、 Lakebaseオートスケールプロジェクトでの統合の仕組み、 DatabricksワークスペースとLakebaseアプリとの関係、エクスポートの構成と確認の方法について説明します。

仕組み

Lakebaseは、お客様のプロジェクト向けに管理されたOpenTelemetryコレクターを実行します。コレクターはコンピュート メトリクスをスクレイピングし、コンピュートからログを受信し、構成した OTLP エンドポイント に転送します。 データはプロジェクト内のブランチとコンピュートを反映します。メトリクスとログは、エンドポイントにサービスを提供するアクティブなコンピュートに関連付けられます。

メトリクス

エクスポートされたメトリクスには次のものが含まれます。

- ホスト / コンピュート メトリクス - コンピュートの CPU とメモリの使用量。

- SQLおよびデータベースのメトリクス ― 接続数、データベースサイズ、レプリケーション遅延、行アクティビティ、および関連するデータベース統計情報。これらのメトリクス名は、接頭辞

lakebase_を付けてエクスポートされます (例:lakebase_connection_counts)。

これらを合わせると、製品内のメトリクスダッシュボードに表示される内容と一致し、OTLP形式でエクスポートされます。

エクスポートされたメトリクス名

マネージドコレクターは、スクレイピングルールとフィルタルールに一致するメトリクスのみを転送します。 ホスト メトリクスは、元のPrometheusスタイルの名前を保持します。 PostgreSQLの メトリクスはエクスポート時に lakebase_ 接頭辞が付きます。監視バックエンドは、OTLPを別の形式に変換する際に、サフィックス(例: _total )を追加または変更する場合があります。

カテゴリー | 含まれる名前(OTLPに送付されたもの) |

|---|---|

ホスト / コンピュート | 名前が |

接続 |

|

データベースのサイズと制限 |

|

レプリケーション |

|

ローカルファイルキャッシュ(LFC) | 元の名前が |

ログ

有効にすると、ログ(エラー、警告、接続関連イベント、および同様のメッセージ)がOTLPログパイプラインに転送されます。設定されたリソース属性 service.name は、バックエンドのログ用の論理サービスを識別します。

前提条件

- LakebaseプロジェクトとDatabricksワークスペースからのLakebaseアプリへのアクセス。 Lakebase Postgres の利用開始方法については、「Lakebase Postgres の利用開始」を参照してください。

- サポートされているOTLP対応のオブザーバビリティバックエンドとその ベースURL 、および 認証情報 (APIキー、ベアラートークン、または基本認証)。

- Databricksが管理するインフラストラクチャからOTLPエンドポイント(例えば、パブリックHTTPSエンドポイント、またはクラウド環境からアクセス可能なコレクター)までのネットワークパス。

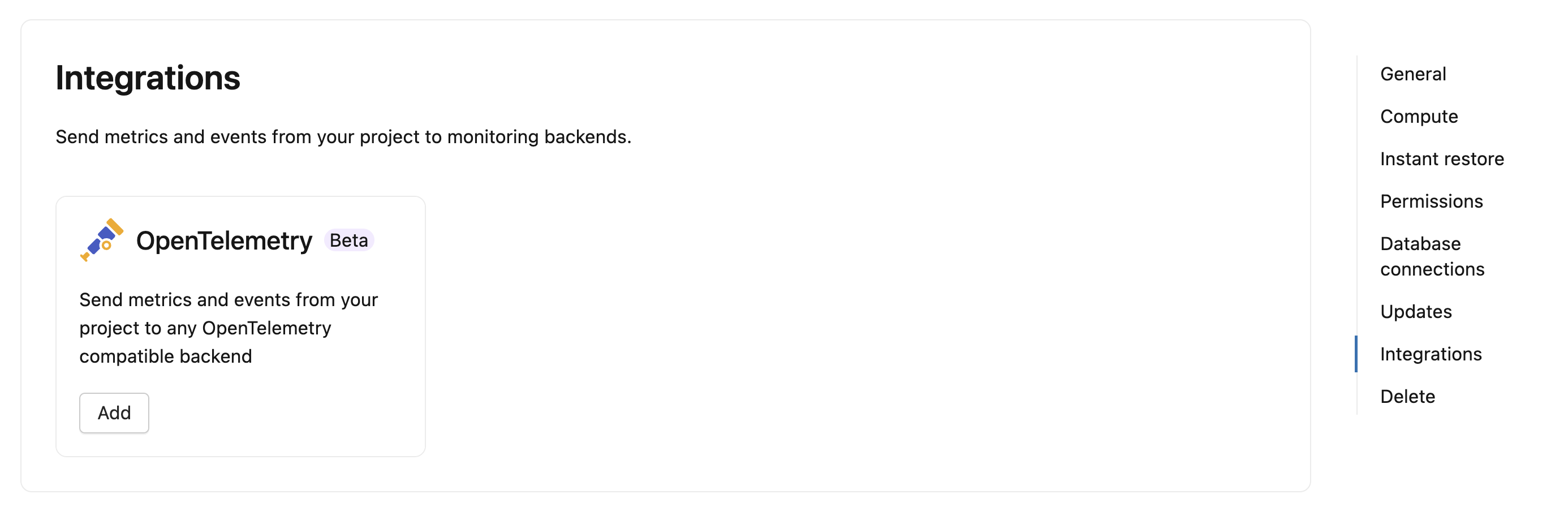

OpenTelemetryの設定を開く

- ワークスペースの Lakebaseアプリ を開き、プロジェクトを選択してください。

- プロジェクトの 設定 を開き、次に 統合 に進みます。OpenTelemetryとの連携機能は、「 連携機能」 セクションで利用できます。

- または、 モニタリング ページから 「テレメトリのエクスポート」 を選択して、OpenTelemetryを設定するプロジェクト設定を開きます。

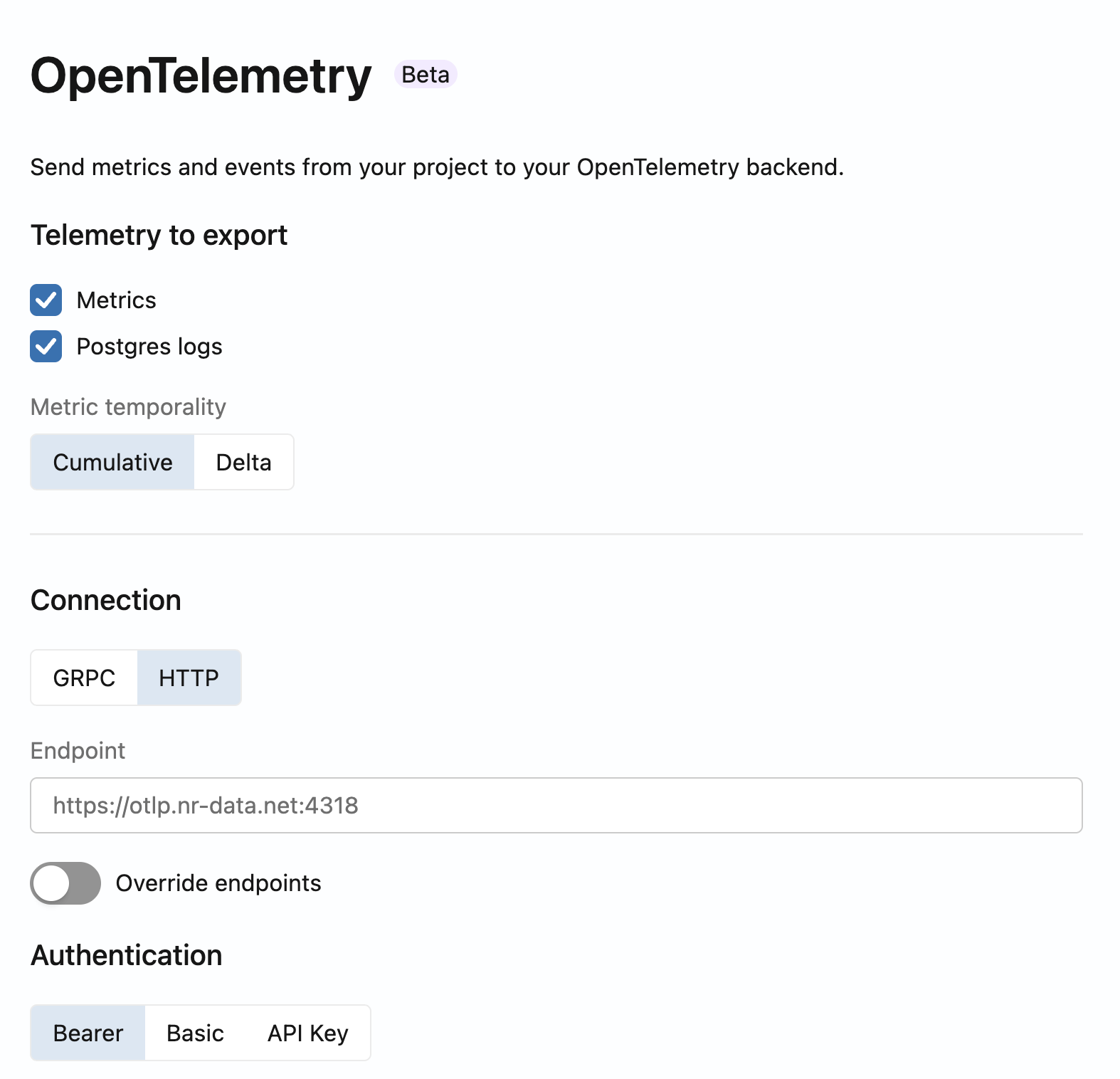

接続プロトコル、エンドポイント、認証、オプションのパスオーバーライド、およびリソース属性をフォームで設定します。

エクスポートするデータを選択してください

どちらか一方、または両方を選択してください。

- メトリクス - 前述のホストおよびSQL /database メトリクス。

- PostgreSQLログ — 可観測性とトラブルシューティングのためのログストリーム。

接続を設定する

-

プロトコル — ほとんどのベンダーでは、 HTTP (OTLP over HTTP、通常はポート4318)が推奨されています。バックエンドまたはネットワークで必要とされる場合は、 gRPC (通常はポート4317)を使用してください。

-

エンドポイント URL —

/v1/metricsまたは/v1/logsを追加せ ずに、 コレクターまたはベンダー OTLP インジェスト エンドポイントの ベース URL を入力します。コレクターは標準のOTLPパスを追加します。/v1/metricsメトリクス用/v1/logsログ用

例:

- Grafana クラウド : スタックの OTLP ゲートウェイ URL (通常は

https://otlp-gateway-<region>.grafana.net/otlp) を使用します。 お住まいの地域の Grafana Cloud OpenTelemetry ドキュメントを参照してください。 - Datadog : Datadog OpenTelemetry セットアップの説明に従って、サイトの OTLP インジェスト URL を使用してください。

プラットフォームが標準以外のパスにメトリクスやログを要求する場合は、フォーム内のオプションの エンドポイントオーバーライド を使用してください(たとえば、メトリクスやログのカスタムパスなど)。ベンダーのドキュメントで要求されている場合にのみ、オーバーライドを設定してください。

-

認証

- Bearer — Bearerトークン(ベンダーによってはライセンストークンやインジェストトークンを使用する場合もあります)。

- 基本情報 — ユーザー名とパスワード。

- APIキー — APIキーの値。バックエンドがデフォルト以外のヘッダー名を期待している場合は、 カスタムヘッダー名 を設定できます(プロバイダーによっては、ベンダー固有のヘッダー名を使用する場合があります)。

詳細オプション

- Deltaメトリクス - 一部のバックエンドは、累積カウンターではなくデルタ時間性を期待します。 プラットフォームで必要な場合は、累積メトリクスをデルタ時間性に変換するオプションを有効にします。

リソース属性を構成する

オブザーバビリティUIでこのLakebaseプロジェクトを識別できるように、 service.name を設定してください。メトリクスは、 compute-host-metrics (ホスト メトリクス) や sql-metrics (データベース メトリクス) などの論理ストリームに編成され、Postgres ログは構成したサービス名に関連付けられます。

保存して確認する

統合を保存します。数分以内に、データがバックエンドに表示されます。

ベンダー固有の設定

グラファナ クラウド

Grafana Cloud UI を使用して OTLP エンドポイント URL と 認証 値を取得し、それらを「接続の設定」で説明されているようにLakebase OpenTelemetry 統合に入力できます。

接続(接続タイルを使用したガイド付きセットアップ)

- Grafana クラウド ポータルにサインインします。

- Grafanaで、 [接続] に移動するか、メニューを展開して [新しい接続を追加] を選択します。

- OpenTelemetry (OTLP) を検索してください。画面の指示に従ってください。 言語とインフラストラクチャとして 「OpenTelemetry SDK 、インフラストラクチャとして 「その他」 、メソッドとして 「OpenTelemetry Collector」 を選択してください。

- 計測手順 ページで、Lakebase OpenTelemetryのエクスポートに使用するトークンを作成または選択します。

- Grafanaが提供する接続の詳細(

OTEL_EXPORTER_OTLP_ENDPOINTとOTEL_EXPORTER_OTLP_HEADERS)をコピーします。

Grafanaの値をLakebaseにマッピングする

- プロトコル — GrafanaまたはネットワークがgRPCを必要とする場合を除き、 HTTP を使用します。Grafana クラウド OTLP ゲートウェイは通常、HTTP 経由で OTLP を使用します。

- エンドポイント URL — ベース OTLP URL (OpenTelemetry ページに

OTEL_EXPORTER_OTLP_ENDPOINTとして表示されている値、またはゲートウェイ URL) のみを使用してください。/v1/metricsや/v1/logsを追加しないでください。Lakebase がそれらのパスを追加します。ホスト名はよくhttps://otlp-gateway-<region>.grafana.net/otlp後に続きます。リージョンとホスト名は異なるため、スタックからの正確な URL を使用してください。 - 認証 — トークンには、Grafana のドキュメントに記載されている方法を使用してください。Grafana がユーザー名とパスワード (インスタンス ID とトークンなど) を提供する場合は Basic 、ベアラー トークンの場合は Bearer 、Grafana がデフォルト以外のヘッダーを指定する場合は、 カスタム ヘッダー名 を使用した API Key を 使用します。Basic認証の場合、Grafanaはbase64エンコードされた値を提供する場合があります。使用する前に、その値をデコードする必要があります。

現在の UI ラベル、オンライン形式、アーキテクチャ ガイダンスについては、Grafana クラウド ドキュメントの「Grafana クラウド OTLP エンドポイントにデータを送信する」を参照してください。

Grafana クラウドのナビゲーションとタイル名は、リリース間で変更される可能性があります。 ポータル内でコントロールの名前が異なる場合は、製品内検索またはリンク先のGrafanaドキュメントを使用して、スタックのOTLP エンドポイント と 認証情報 を検索してください。

データが Grafana クラウドに到着したら、 Explore と Loki を使用して、メトリクスとログを受信していることを確認します。

データドッグ

Lakebaseのメトリクスとログは、DatadogのOTLP取り込みエンドポイントを使用してDatadogに送信できます。Datadogは、カウンターやヒストグラムにおいて、 時間軸が変化する 場合に最も効果を発揮します。Lakebase OpenTelemetry 設定で Delta オプションを有効にします。

Datadog OTLPエンドポイントを見つける

OTLPエンドポイントのURLは、ご利用のDatadogサイトによって異なります。共通の価値観:

Datadogサイト | OTLPエンドポイント(HTTP) |

|---|---|

US1 (datadoghq.com) |

|

US3 (us3.datadoghq.com) |

|

US5 (us5.datadoghq.com) |

|

EU1 (datadoghq.eu) |

|

AP1 (ap1.datadoghq.com) |

|

その他のDatadogサイトについては、Datadogドキュメントの「Datadog OTLP取り込み」を参照してください。

Datadogの値をLakebaseにマッピングする

- プロトコル — HTTP を使用する(ポート4318でHTTP上のOTLP)。Datadogは、ネットワーク構成で必要な場合、gRPC(ポート4317)もサポートします。

- エンドポイントURL — DatadogサイトのベースOTLP URLを入力します(上記の表を参照)。

/v1/metricsや/v1/logsを追加しないでください。Lakebase がこれらのパスを自動的に追加します。 - 認証 — APIキー 認証を使用します。値としてDatadog APIキーを入力し、ヘッダー名を

DD-API-KEYに設定してください。 - Deltaメトリクス - Delta 詳細オプション でメトリクス を有効にします。Datadogは、カウンターとヒストグラムに対して、差分時間性(デルタ時間性)を期待します。この設定がないと、累積カウンターによってDatadogで誤ったレート計算や重複カウントが発生する可能性があります。

データが Datadog に到着したら、 メトリクス エクスプローラー を使用してlakebase_メトリクスと ログ を検索し、構成されたservice.nameでログが到着していることを確認します。

DatadogはOTLPデータを取り込む際に、独自の命名規則を適用します。たとえば、ヒストグラム メトリクスに.countまたは.sumを追加したり、ドットをアンダースコアに変換したりできます。 メトリクス名の変換方法の詳細については、 「Datadog OTLP メトリクス マッピング」を参照してください。

トラブルシューティング

- データがありません — OTLP URL、プロトコル、および認証情報を確認してください。コンピュートがゼロにスケールされていないことを確認します。 コンピュートを起動するテスト クエリを実行します。

- エクスポート時の HTTP 404 — 多くの場合、バックエンドが

{base}/v1/metricsまたは{base}/v1/logsで OTLP を受け入れていないことを意味します。プラットフォームが標準以外のパスを使用している場合は、ベンダーのドキュメントを確認するか、パスの上書き設定を使用してください。 - 保存時の検証エラー — 製品はOTLPエンドポイントへの到達可能性をテストできます。検証に失敗した場合は、ファイアウォールとTLSの要件を確認し、リージョンURLを検証し、バックエンドが選択されたOTLP HTTPまたはgRPCをサポートしていることを確認してください。

外部エクスポートを行わない製品内メトリクスについては、 「メトリクス ダッシュボード」を参照してください。 Postgres 経由で接続するクライアント専用ツールについては、 「外部モニタリング ツール」を参照してください。

次のステップ

- Lakebaseプロジェクトの監視 :組み込みツールと外部ツールを使用して、パフォーマンス、リソース使用量、クエリ分析を追跡します。モニターを参照してください。

- メトリクスの表示 :製品内のメトリクスダッシュボードで、CPU、メモリ、接続、データベースの統計情報を確認できます。メトリクスダッシュボードをご覧ください。

- 外部監視ツールに接続する : 標準の Postgres プロトコルを使用して、pgAdmin または PgHero でデータベースを監視します。 「外部モニタリング ツール」を参照してください。