Configure o endpoint do Unity AI Gateway.

Beta

Este recurso está em versão Beta. Os administradores da conta podem controlar o acesso a este recurso na página de pré-visualizações do console account . Veja as prévias do Gerenciador Databricks.

Esta página descreve como configurar o endpoint do Unity AI Gateway .

Requisitos

- A pré-visualização do Unity AI Gateway foi ativada para sua account. Veja as prévias do Gerenciador Databricks.

- Um workspace Databricks em uma região compatível com o Unity AI Gateway.

- Unity Catalog está habilitado para seu workspace. Consulte Ativar um workspace para Unity Catalog.

- O usuário que cria ou modifica o endpoint deve ter permissão

CAN MANAGEno endpoint. Ver Listas de controle de acesso.

Crie um endpoint do Unity AI Gateway

Para criar um endpoint do Unity AI Gateway:

- Na barra lateral, clique em AI Gateway .

- Clique em Criar endpoint do Unity AI Gateway .

- Configure o nome do seu endpoint e o modelo principal.

- Clique em Criar .

Configure o recurso em um endpoint

Você pode atualizar o endpoint do Unity AI Gateway para habilitar e desabilitar o recurso. As atualizações nas configurações do Unity AI Gateway podem levar até 1 minuto para entrar em vigor.

Para atualizar o recurso do Unity AI Gateway em um endpoint existente:

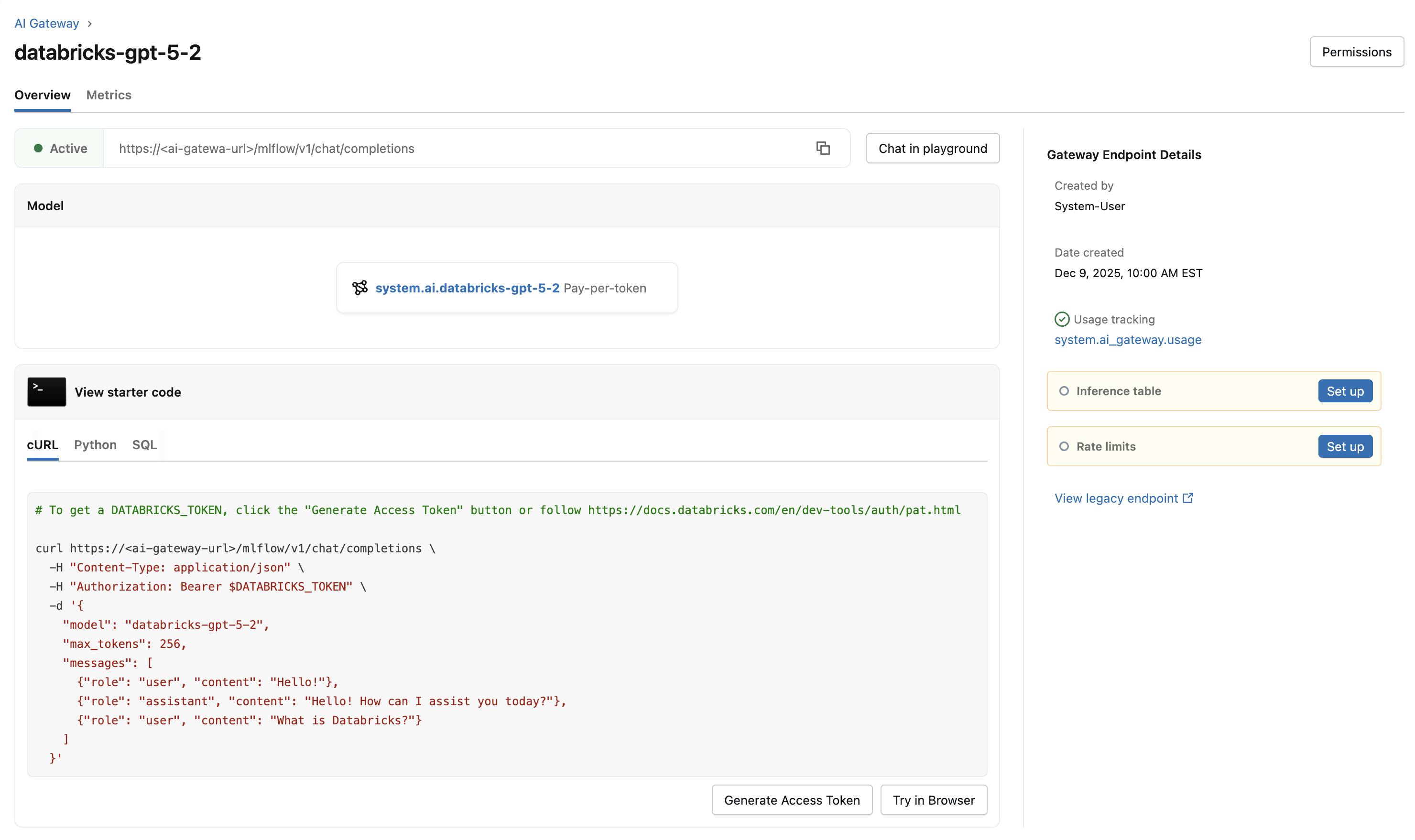

- Clique no seu endpoint na página do AI Gateway.

- Na barra lateral Detalhes do ponto de extremidade do Gateway, clique no ícone de edição ao lado do recurso que deseja atualizar.

- Faça as alterações e clique em Salvar .

A tabela a seguir resume os recursos disponíveis do Unity AI Gateway e como configurá-los:

Recurso | Como configurar | Detalhes |

|---|---|---|

Ativado por default. |

| |

Selecione Ativar tabelas de inferência para log solicitações e respostas. |

| |

Selecione os limites de taxa para configurar consultas por minuto (QPM) ou tokens por minuto (TPM). |

| |

Selecione "Guardrails" para configurar as políticas de conteúdo. |

| |

Fallbacks | Selecione Adicionar modelo fallback para configurar os modelos fallback . |

|

Divisão de tráfego | Selecione " Adicionar divisão de tráfego" para distribuir as solicitações entre vários back-ends de modelo. |

|

APIs personalizadas | Selecione API personalizada ao criar um endpoint para conectar-se a uma API externa. |

|

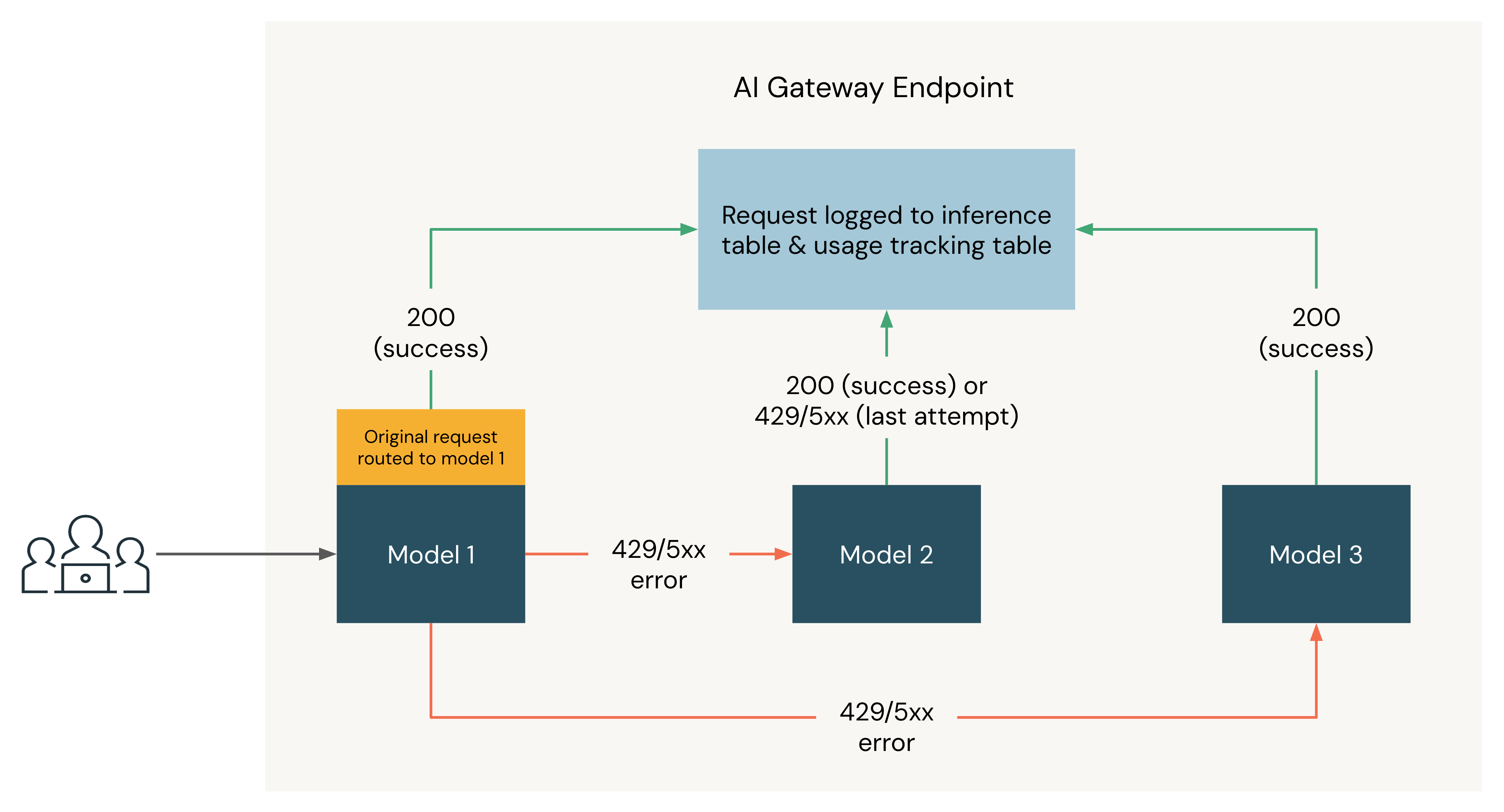

O diagrama a seguir mostra um exemplo de fallback em que três modelos são registrados como destinos de um endpoint do Unity AI Gateway:

- A solicitação é originalmente encaminhada para o Modelo 1.

- Se a solicitação retornar uma resposta 200, significa que a solicitação foi bem-sucedida no Modelo 1 e a solicitação e sua resposta são registradas nas tabelas de acompanhamento e inferência de uso.

- Se a solicitação retornar um erro

429ou5XXno Modelo 1, a solicitação recorrerá ao próximo modelo no endpoint, o Modelo 2. - Se a solicitação retornar um erro

429ou5XXno Modelo 2, a solicitação recorrerá ao próximo modelo no endpoint, o Modelo 3. - Se a solicitação retornar um erro

429ou5XXno Modelo 3, a solicitação falhará, pois todos os modelos de fallback foram tentados. A solicitação com falha e o erro de resposta são registros nas tabelas de acompanhamento e inferência de uso.

Próximos passos

- Portal AI Unity para agentes e LLMs

- Consultar o endpoint do Unity AI Gateway

- Integre com agentes de codificação

- Monitore o uso do endpoint do Unity AI Gateway.

- Monitorar modelos usando tabelas de inferência

- Configure os limites de taxa para o endpoint do Unity AI Gateway.

- Configure a divisão de tráfego para o endpoint do Unity AI Gateway.