Instrutor de rastreamento

O Instructor é um código aberto Python biblioteca desenvolvido com base no Pydantic, simplificando as saídas estruturadas do LLM com validação, novas tentativas e transmissão.

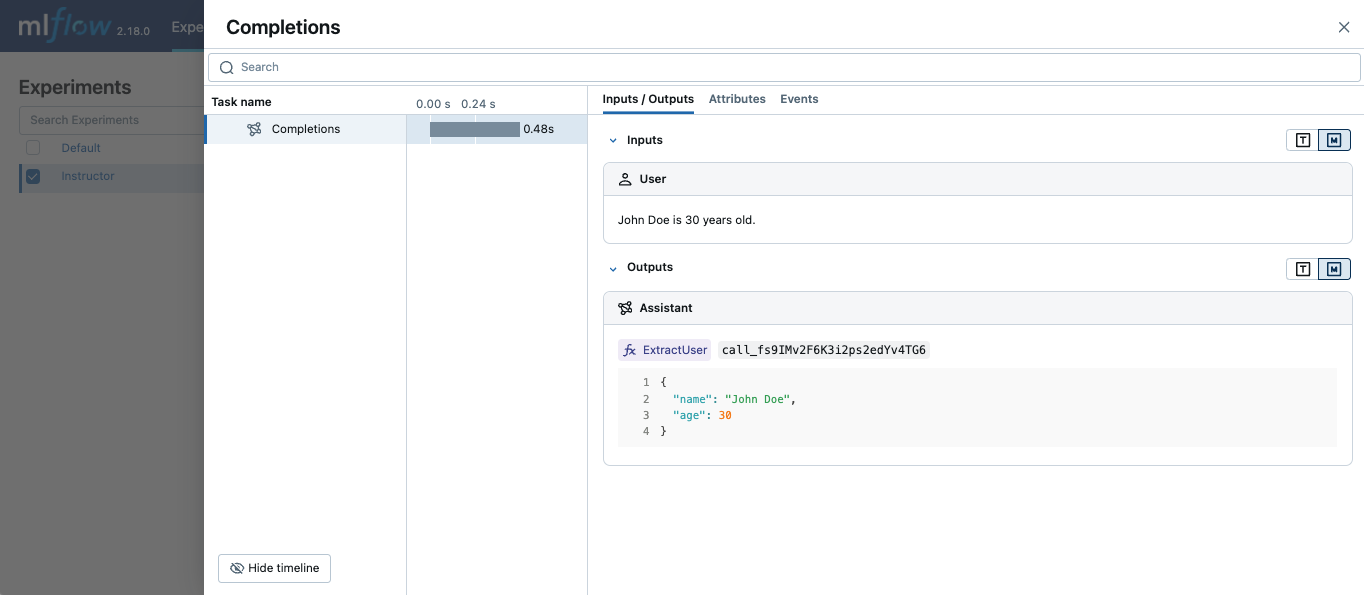

MLflow Tracing Funciona com o Instructor, ativando o rastreamento automático para a biblioteca LLM subjacente. Por exemplo, se você usar o Instructor para OpenAI LLMs, poderá ativar o rastreamento com mlflow.openai.autolog() e os rastreamentos gerados capturarão as saídas estruturadas do Instructor.

Da mesma forma, o senhor também pode rastrear o instrutor com outros provedores de LLM, como Anthropic, Gemini e LiteLLM, ativando o autologging correspondente no MLflow.

Em serverless compute clusters, o autologging não é ativado automaticamente. Você deve chamar explicitamente a função de registro automático apropriada (por exemplo, mlflow.openai.autolog() oumlflow.anthropic.autolog()) para ativar o rastreamento automático para essa integração.

Exemplo de uso

O exemplo a seguir mostra como rastrear a chamada do instrutor que envolve uma API OpenAI.

import instructor

from pydantic import BaseModel

from openai import OpenAI

import mlflow

# Use other autologging function e.g., mlflow.anthropic.autolog() if you are using Instructor with different LLM providers

mlflow.openai.autolog()

# Set up MLflow tracking on Databricks

mlflow.set_tracking_uri("databricks")

mlflow.set_experiment("/Shared/instructor-demo")

# Use Instructor as usual

class ExtractUser(BaseModel):

name: str

age: int

client = instructor.from_openai(OpenAI())

res = client.chat.completions.create(

model="gpt-4o-mini",

response_model=ExtractUser,

messages=[{"role": "user", "content": "John Doe is 30 years old."}],

)

print(f"Name: {res.name}, Age:{res.age}")

Próximos passos

- Entenda os conceitos de rastreamento - Saiba como o MLflow captura e organiza os dados de rastreamento

- Depure e observe seu aplicativo - Use a interface do usuário do Trace para analisar o comportamento do seu aplicativo Instructor

- Avalie a qualidade do seu aplicativo - Configure a avaliação de qualidade para seu aplicativo de saída estruturada