マネージド データベース コネクタ

Databricks LakeFlow Connect 、チェンジデータキャプチャ ( CDC ) を使用してリレーショナル データベースからデータを取り込むためのフルマネージド コネクタを提供します。 各コネクタは、データベース内の変更を効率的に追跡し、それらをDeltaテーブルに段階的に適用します。

サポートされているコネクタ

-

- MySQL

- データチェンジキャプチャ ( CDC ) を使用してMySQLデータベースからデータを取り込み、効率的な増分ロードを実現します。

-

- PostgreSQL

- チェンジデータキャプチャ ( CDC ) を使用してPostgreSQLデータベースからデータを取り込みます。

-

- Microsoft SQL Server

- チェンジ データ キャプチャ ( CDC ) またはフル スナップショットを使用してMicrosoft SQL Serverからデータを取り込みます。

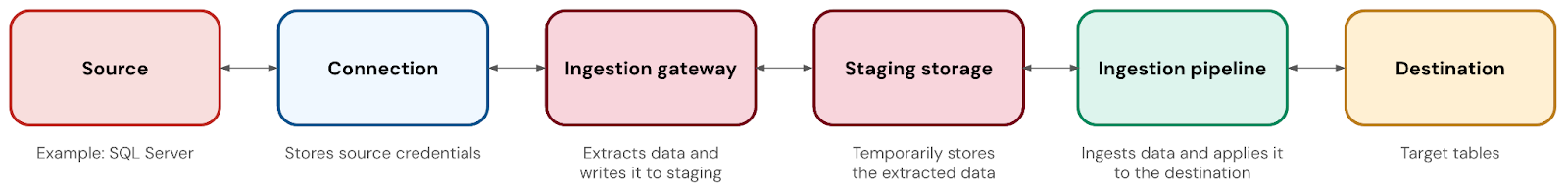

コネクタ部品

データベースコネクタは、以下のコンポーネントで構成されています。

コンポーネント | 説明 |

|---|---|

接続 | データベースの認証情報を格納する、 Unity Catalogセキュリティ保護可能なオブジェクト。 |

取り込みゲートウェイ | ソースデータベースからスナップショット、変更ログ、メタデータを抽出するパイプライン。ゲートウェイはクラシック コンピュートで実行され、変更ログがソース内で切り詰められる前に変更をキャプチャするために継続的に実行されます。 |

ステージングストレージ | 抽出されたデータを宛先テーブルに適用する前に一時的に保存する Unity Catalog ボリューム。これにより、ゲートウェイが継続的に変更をキャプチャしている場合でも、任意のスケジュールで取り込み パイプラインを実行できます。また、障害の回復にも役立ちます。ゲートウェイをデプロイするときにステージングストレージボリュームを自動的に作成し、その保存場所のカタログとスキーマをカスタマイズできます。データは 30 日後にステージングから自動的に消去されます。 |

取り込みパイプライン | ステージングストレージから宛先テーブルにデータを移動するパイプライン。この取り込みパイプラインはサーバレスコンピュートで実行されます。 |

宛先テーブル | 取り込み パイプラインがデータを書き込むテーブル。これらは ストリーミングテーブルであり、増分データ処理の追加サポートを備えた Delta テーブルです。 |

ネットワーク接続

インジェスト ゲートウェイは、 DatabricksワークスペースVPCまたは VNet のクラシック コンピュート上で実行され、ネットワーク経由でソース データベースにアクセスできる必要があります。

VPN、Azure ExpressRoute、AWS Direct Connect、VPCまたはVNetピアリング、パブリックエンドポイントなど、ゲートウェイがデータベースにアクセスできるネットワークパスはすべてサポートされています。

クラウド間接続に対応しています。例えば、 Azure Databricksは、2つの環境間に適切なネットワーク接続が存在する場合、 AWS Aurora PostgreSQLデータベースからデータを取り込むことができます。