Portal AI Unity para agentes e LLMs

Beta

Esta página aborda o novo Gateway AI (visível na barra de navegação à esquerda da interface do usuário), que está atualmente em versão Beta. Os administradores da conta podem habilitar o acesso a este recurso na página de pré-visualizações do console account . Veja as prévias do Gerenciador Databricks.

Para obter detalhes sobre a versão anterior do Unity AI Gateway, consulte Unity AI Gateway para endpoint de serviço.

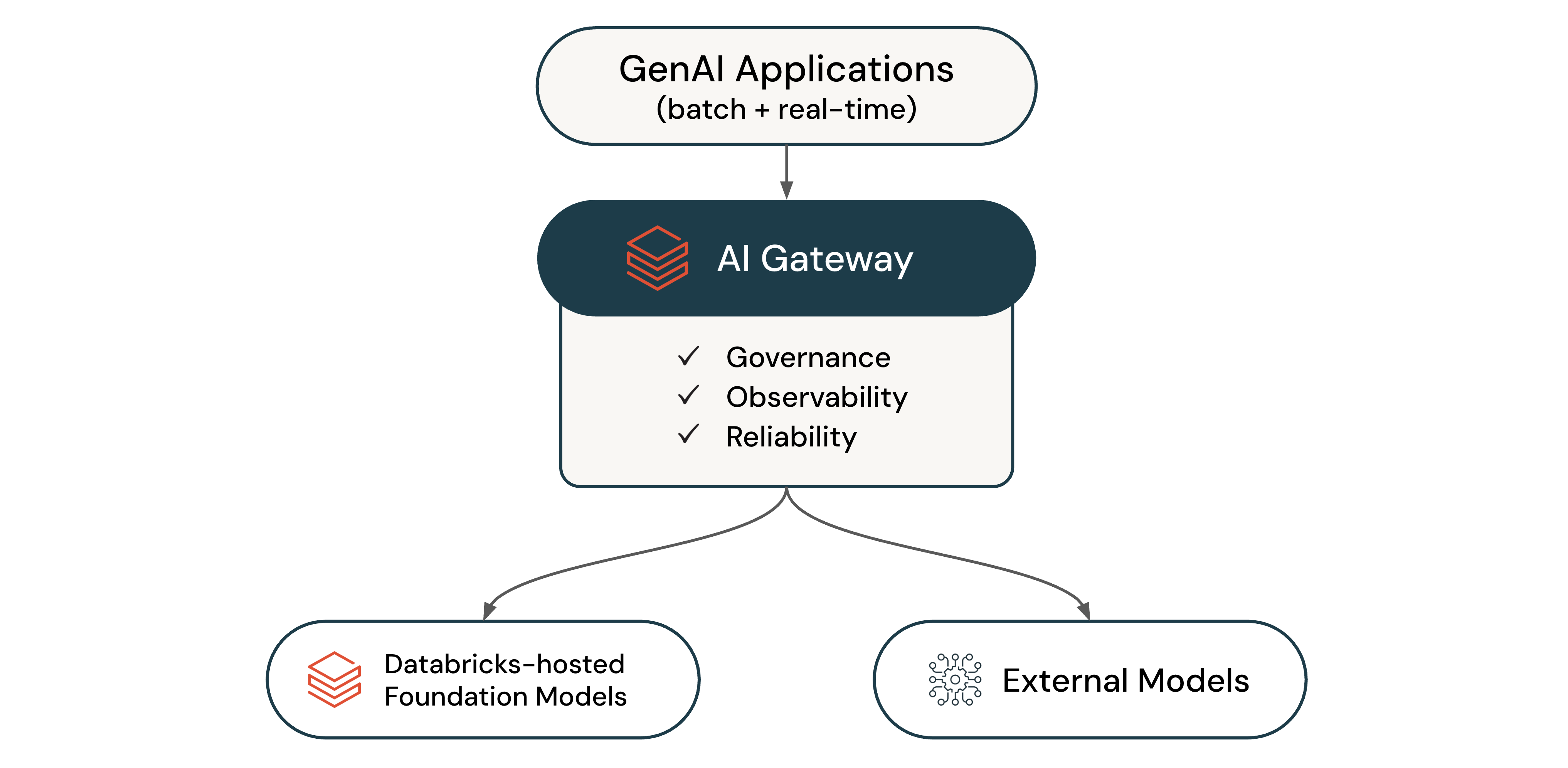

O que é o Unity AI Gateway?

O Unity AI Gateway é o plano de controle empresarial para governar endpoints, agentes e ferramentas de codificação LLM . Utilize-o para analisar o uso, configurar permissões e gerenciar a capacidade entre provedores.

Com o Unity AI Gateway, você pode:

- Analise como os LLMs, os agentes e as ferramentas de codificação são utilizados na sua organização.

- Gerencie o acesso a modelos hospedados no Databricks e modelos externos.

- Registrar o tráfego LLM em todos os endpoints para Unity Catalog

- Monitore a integridade do endpoint e a disponibilidade do provedor.

- Aplique limites de taxa e barreiras de segurança no nível de endpoint, usuário ou grupo

- Atribua custos a endpoints, usuários e equipes específicos.

- Direcione o tráfego de forma inteligente entre provedores para garantir confiabilidade e balanceamento de carga.

- Divida o tráfego entre vários backends de modelo para escalabilidade.

- Troque de provedor e modelo sem alterações no código.

Recurso suportado

A tabela a seguir define os recursos disponíveis do Unity AI Gateway:

Recurso | Descrição |

|---|---|

Permissões | Controle quem tem acesso ao seu endpoint. |

Monitore o uso e os custos utilizando tabelas do sistema. | |

Monitorar e auditar solicitações e respostas nas tabelas Delta Unity Catalog . | |

Mérito operacional | Monitore o uso em tempo real. |

Imponha limites de consumo no nível do endpoint, do usuário ou do grupo. | |

Aplique filtragem de conteúdo, proteção de dados sensíveis e políticas personalizadas. | |

Analise o custo Databricks para o endpoint do Unity AI Gateway, modelos de destino, entidades principais e tags na tabela de uso faturável do sistema e no painel de controle de uso. | |

Fallbacks | Aumente a confiabilidade encaminhando os dados para vários provedores quando ocorrerem falhas. |

Divisão de tráfego | Distribua o tráfego entre vários backends de modelos para melhor escalabilidade e balanceamento de carga. |

APIs personalizadas | Controle APIs personalizadas e externas com os mesmos controles de acesso, limites de taxa e registro de logs do endpoint LLM . |

O recurso Unity AI Gateway não gera custos durante a versão Beta.

Use o Unity AI Gateway

Databricks fornece um endpoint Unity AI Gateway para plataformas populares de aprendizado de máquina. Você pode criar novos endpoints para controlar agentes, ferramentas de codificação e outros aplicativos.

Para começar, consulte Configurar o endpoint do Unity AI Gateway. Para consultar o endpoint, consulte Consultar o endpoint do Unity AI Gateway. Para integrar agentes de codificação como Cursor, Gemini CLI, Codex CLI e Claude Code, consulte Integrar com agentes de codificação. Para encaminhar chamadas LLM de agentes que você cria e implanta em Databricks Apps por meio do Unity AI Gateway, consulte a etapa 4. Gerencie o uso LLM de seus agentes em Databricks Apps com o Unity AI Gateway.

Início rápido de consultas

Diga ao Genie Code (modo Agente) para fazer isso por você:

Create a new notebook that queries a :re[ai-gateway] endpoint using Python and the OpenAI client.

O exemplo a seguir mostra como consultar um endpoint do Unity AI Gateway usando Python e o cliente OpenAI:

from openai import OpenAI

import os

# To get a Databricks token, see https://docs.databricks.com/dev-tools/auth/pat

DATABRICKS_TOKEN = os.environ.get('DATABRICKS_TOKEN')

client = OpenAI(

api_key=DATABRICKS_TOKEN,

base_url="https://<workspace-url>/ai-gateway/mlflow/v1"

)

chat_completion = client.chat.completions.create(

messages=[

{"role": "user", "content": "Hello!"},

{"role": "assistant", "content": "Hello! How can I assist you today?"},

{"role": "user", "content": "What is Databricks?"},

],

model="databricks-gpt-5-2",

max_tokens=256

)

print(chat_completion.choices[0].message.content)

Substitua <workspace-url> pela URL do seu workspace Databricks .

Próximos passos

- Configure o endpoint do Unity AI Gateway.

- Consultar o endpoint do Unity AI Gateway

- Integre com agentes de codificação

- Agentes de governança em Databricks Apps

- Monitore o uso do endpoint do Unity AI Gateway.

- Monitorar modelos usando tabelas de inferência

- Configure os limites de taxa para o endpoint do Unity AI Gateway.