Conectores de banco de dados gerenciados

Databricks LakeFlow Connect fornece conectores totalmente gerenciados para ingestão de dados de bancos de dados relacionais usando captura de dados de alterações (CDC) (CDC). Cada conector rastreia de forma eficiente as alterações no banco de dados de origem e as aplica incrementalmente às tabelas Delta.

Conectores suportados

-

- MySQL

- Ingira dados de bancos de dados MySQL usando captura de dados de alterações (CDC) (CDC) para cargas incrementais eficientes.

-

- PostgreSQL

- Ingerir dados de bancos de dados PostgreSQL usando captura de dados de alterações (CDC) (CDC).

-

- Microsoft SQL Server

- Ingerir dados do Microsoft SQL Server usando captura de dados de alterações (CDC) (CDC) ou snapshot completo.

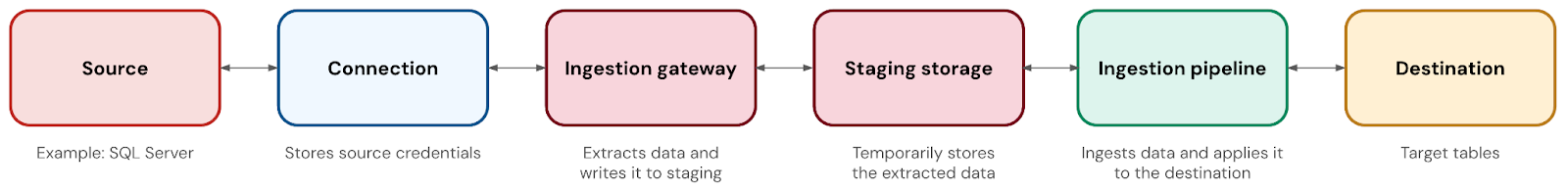

Componentes de conexão

Um conector de banco de dados possui os seguintes componentes:

Componente | Descrição |

|---|---|

Conexão | Um objeto protegível do Unity Catalog que armazena detalhes de autenticação para o banco de dados. |

Portal de ingestão | Um pipeline que extrai snapshots, logs de alterações e metadados do banco de dados de origem. A execução do gateway em compute clássica é contínua, capturando alterações antes que logs de alterações sejam truncados na origem. |

armazenamento temporário | Um volume Unity Catalog que armazena temporariamente os dados antes de serem aplicados à tabela de destino. Isso permite que você execute seu pipeline de ingestão no ritmo que desejar, mesmo enquanto o gateway captura continuamente as alterações. Também auxilia na recuperação de falhas. Ao implantar o gateway, você cria automaticamente um volume de armazenamento temporário e pode personalizar o catálogo e o esquema onde ele reside. Os dados são apagados automaticamente da área de preparação após 30 dias. |

pipelinede ingestão | Um pipeline que move os dados do armazenamento temporário para as tabelas de destino. A execução pipeline na compute serverless . |

Tabelas de destino | As tabelas onde o pipeline de ingestão grava os dados. Essas são tabelas de transmissão, que são tabelas Delta com suporte adicional para processamento incremental de dados. |

Conectividade de rede

O gateway de ingestão deve ser executado em um compute clássico na sua VPC ou VNet workspace Databricks e precisa ser capaz de acessar o banco de dados de origem pela rede.

Qualquer caminho de rede que permita ao gateway alcançar o banco de dados é suportado, incluindo VPN, Azure ExpressRoute, AWS Direct Connect, peering VPC ou VNet e endpoint público.

A conectividade entrecloud é suportada. Por exemplo, um workspace Azure Databricks pode ingerir dados de um banco de dados AWS Aurora PostgreSQL desde que exista conectividade de rede adequada entre os dois ambientes.