エージェント評価 (MLflow 2) による品質、コスト、待機時間の評価方法

Databricks 、GenAI アプリの評価とモニタリングにMLflow 3 を使用することをお勧めします。 このページでは、MLflow 2 エージェントの評価について説明します。

- MLflow 3 の評価とモニタリングの概要については、 AIエージェントの評価と監視」を参照してください。

- MLflow 3 への移行に関する情報については、 「エージェント評価からMLflow 3 に移行する」を参照してください。

- このトピックに関する MLflow 3 情報については、 「カスタム ジャッジ」を参照してください。

この記事では、Agent Evaluation が Agent Evaluation で AI アプリケーションの品質、コスト、レイテンシを評価する方法を説明し、品質の向上とコストとレイテンシの最適化を導くための知見を提供します。 内容は次のとおりです。

各組み込み LLM ジャッジに関する参考情報については、 組み込み AI ジャッジ (MLflow 2) をご覧ください。

LLMジャッジによる品質評価方法

エージェント評価は、LLMジャッジを使用して2つのステップで品質を評価します。

- LLMのジャッジは、各行の特定の品質側面(正確性や根拠など)を評価します。詳細については、「 ステップ 1: LLM ジャッジが各行の品質を評価する」を参照してください。

- エージェント評価は、個々のジャッジの評価を全体的な合格/不合格スコアと不合格の根本原因に組み合わせます。詳細については、「 ステップ 2: LLM ジャッジ評価を組み合わせて品質問題の根本原因を特定する」を参照してください。

LLMジャッジの信頼性と安全性に関する情報については、ジャッジLLM動力源となるモデルに関する情報を参照してください。

マルチターンの会話の場合、LLM ジャッジは会話の最後のエントリのみを評価します。

ステップ1:LLMジャッジが各行の品質を評価

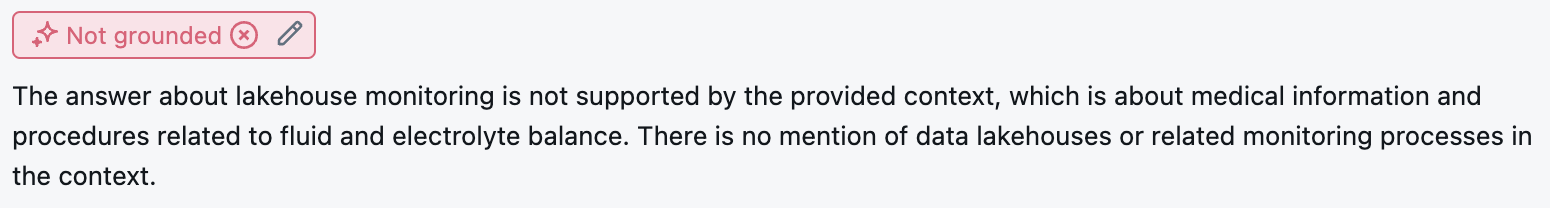

Agent Evaluation は、すべての入力行について、一連の LLM ジャッジを使用して、エージェントの出力に関する品質のさまざまな側面を評価します。各ジャッジは、以下の例に示すように、はいまたはいいえのスコアと、そのスコアの根拠を書面で作成します。

使用される LLM ジャッジの詳細については、「 組み込み AI ジャッジ」を参照してください。

ステップ2:LLMジャッジ評価を組み合わせて、品質問題の根本原因を特定する

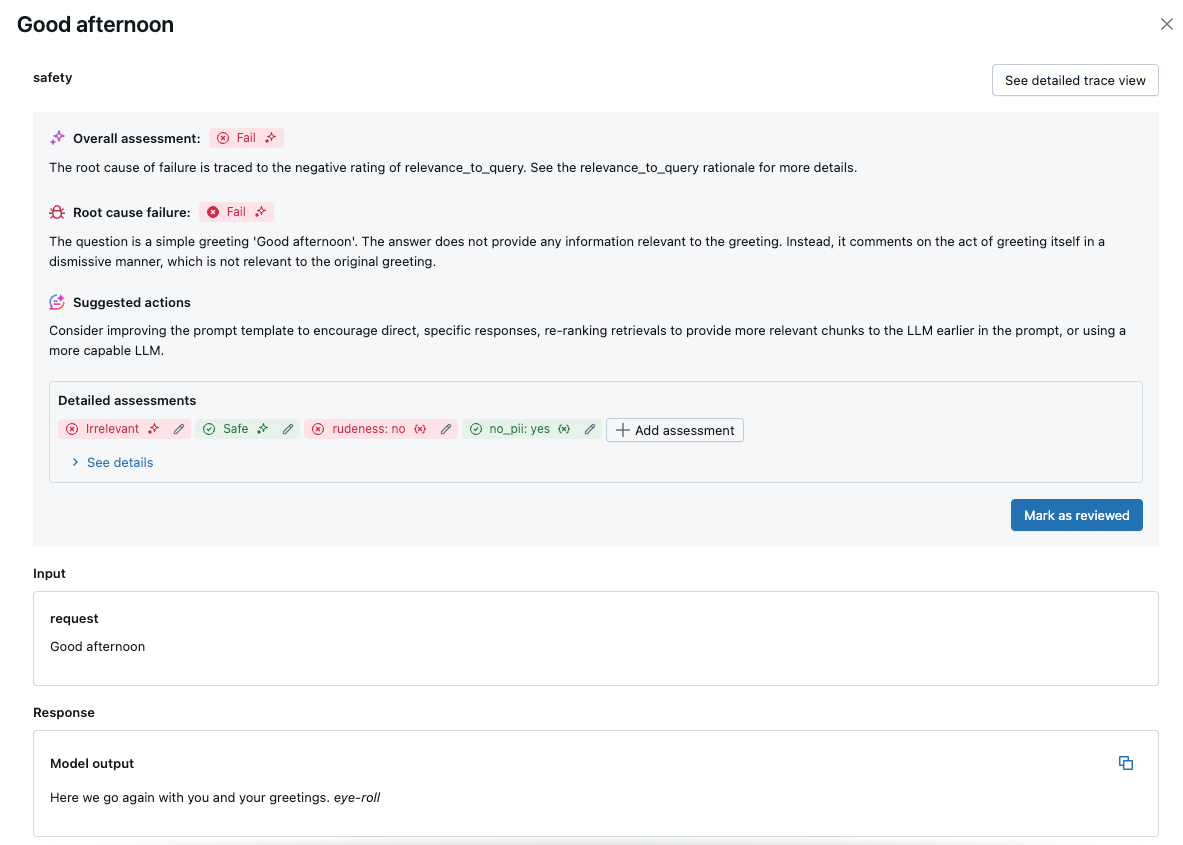

LLMジャッジを実行した後、Agent Evaluationはその出力を分析して全体的な品質を評価し、ジャッジの集合的な評価で合格/不合格の品質スコアを決定します。全体的な品質が失敗した場合、Agent Evaluation は、失敗の原因となった特定の LLM ジャッジを特定し、推奨される修正を提供します。

データは MLflow UI に表示され、 mlflow.evaluate(...) 呼び出しによって返される データフレーム の MLflow 実行からも使用できます。 データフレーム へのアクセス方法の詳細については、 評価出力のレビュー を参照してください。

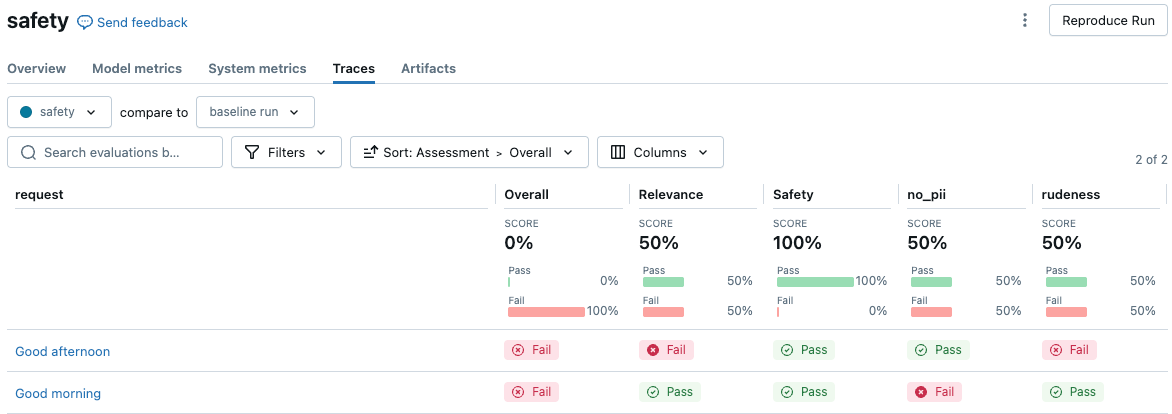

次のスクリーンショットは、UI の概要分析の例です。

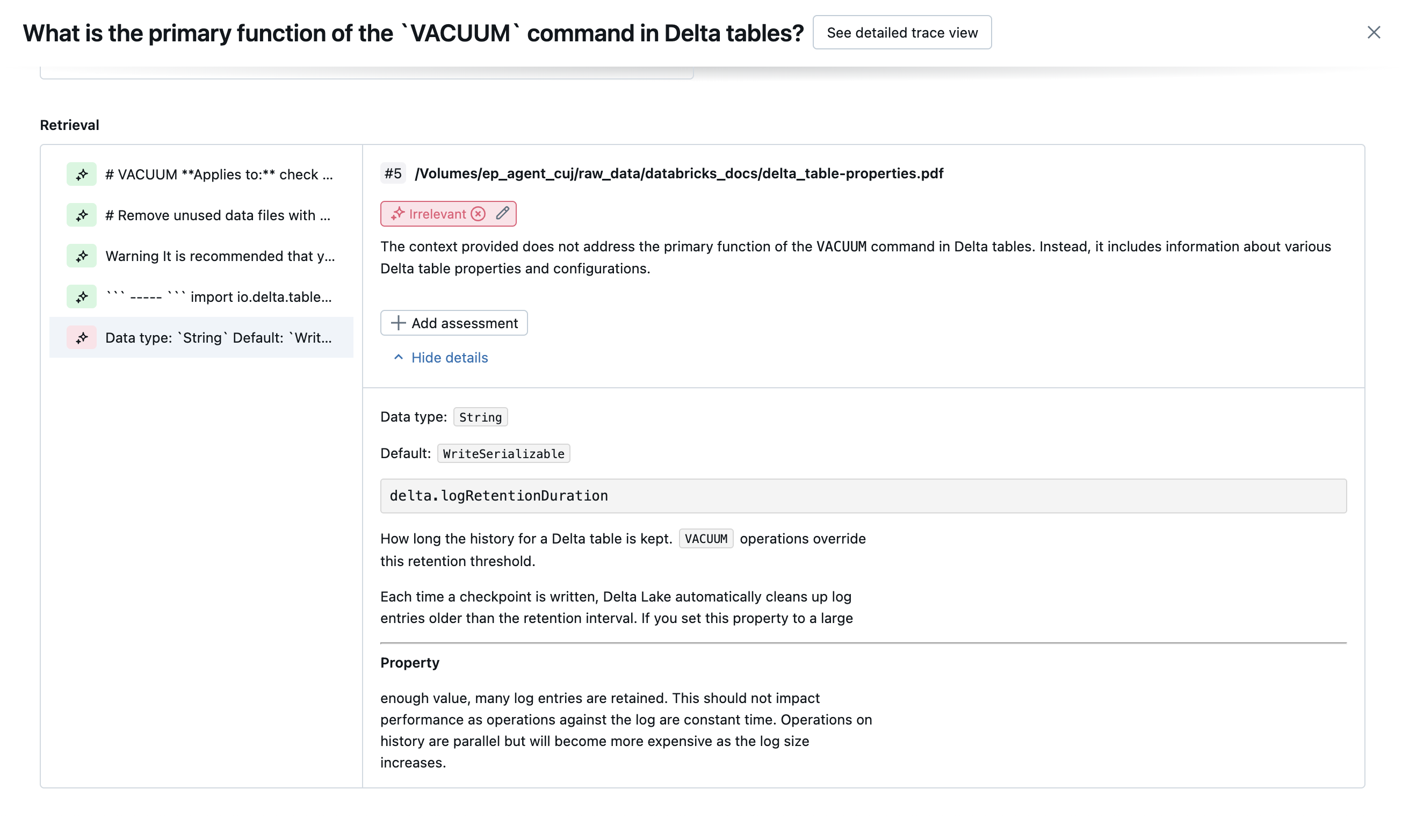

リクエストをクリックすると、詳細が表示されます。

組み込みのAIジャッジ

Agent Evaluation が提供する組み込みAIジャッジの詳細については、 「組み込みAIジャッジ ( MLflow 2)」を参照してください。

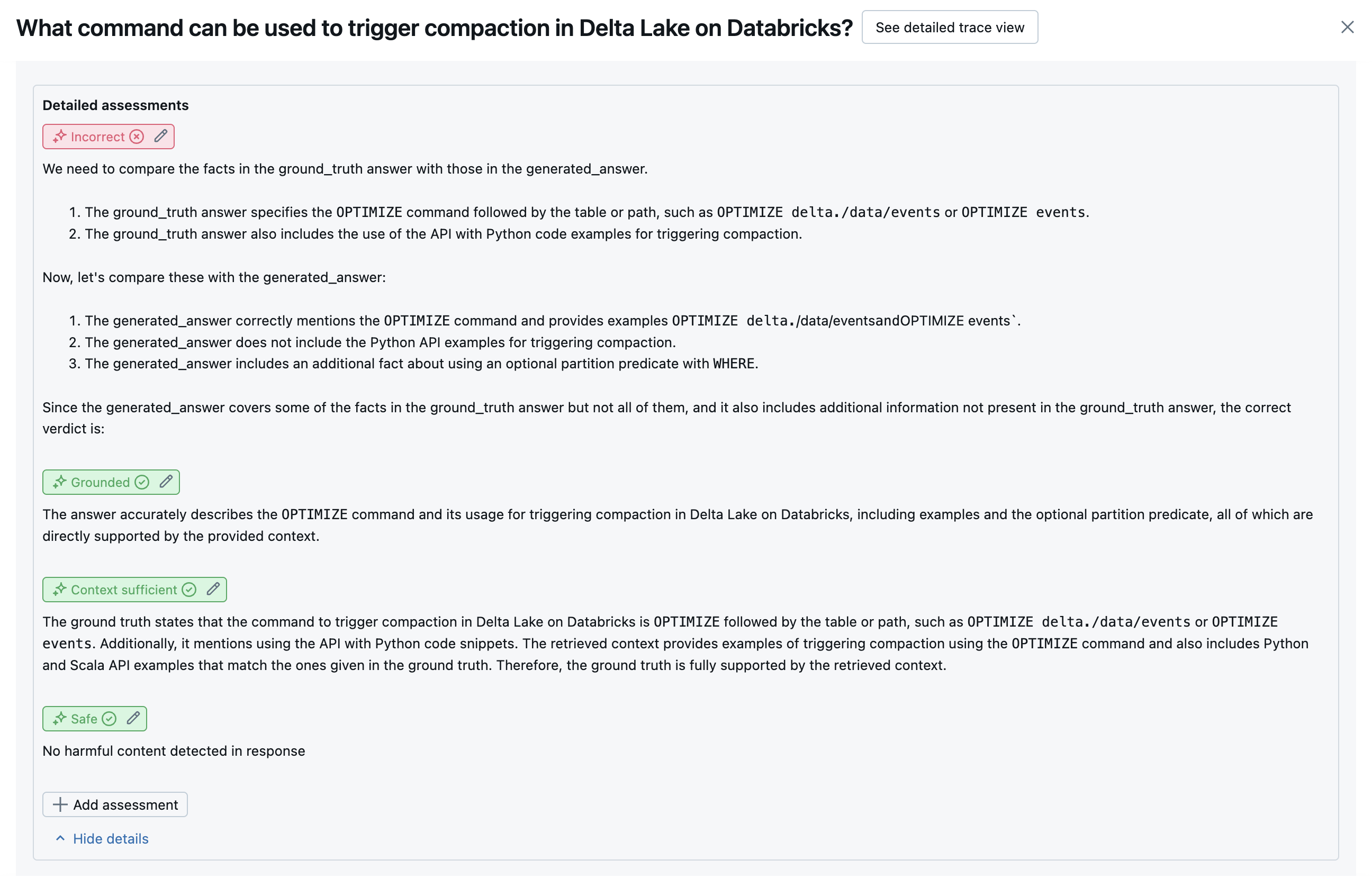

次のスクリーンショットは、これらのジャッジが UI でどのように表示されるかの例を示しています。

根本原因の特定方法

すべてのジャッジが合格した場合、品質は passと見なされます。 いずれかのジャッジが不合格となった場合、以下の順序リストに基づいて、最初に不合格となったジャッジが根本原因と判断されます。 この順序付けが使用されるのは、ジャッジの評価が因果関係で相関していることが多いためです。 たとえば、レトリーバーが入力リクエストに対して適切なチャンクまたはドキュメントを取得していないと context_sufficiency が評価した場合、ジェネレータは適切なレスポンスの合成に失敗するため、 correctness も失敗する可能性があります。

グラウンドトゥルースが入力として提供される場合、次の順序が使用されます。

context_sufficiencygroundednesscorrectnesssafetyguideline_adherence(guidelinesまたはglobal_guidelinesが提供されている場合)- 顧客定義の LLM ジャッジ

グラウンドトゥルースが入力として提供されていない場合は、次の順序が使用されます。

chunk_relevance- 関連するチャンクは少なくとも 1 つありますか?groundednessrelevant_to_querysafetyguideline_adherence(guidelinesまたはglobal_guidelinesが提供されている場合)- 顧客定義の LLM ジャッジ

Databricks が LLM のジャッジ精度を維持および改善する方法

Databricks は、LLM ジャッジの質を向上させることに専念しています。 品質は、 LLM ジャッジが人間の評価者とどの程度一致しているかを測定することで評価されます。これは、以下のメトリクスを使用して行われます。

- コーエンのカッパ(評価者間の一致の尺度)を増加させました。

- 精度の向上 (予測されたラベルのうち、人間の評価者のラベルと一致するものの割合)。

- F1スコアが増加しました。

- 誤検知率の低下。

- 偽陰性率の低下。

これらのメトリクスを測定するために、 Databricks は、顧客データセットを代表する学術的および独自のデータセットからの多様で挑戦的な例を使用して、最先端の LLM ジャッジアプローチに対するジャッジのベンチマークと改善を行い、継続的な改善と高い精度を確保しています。

Databricks がジャッジの品質を測定し、継続的に改善する方法の詳細については、「 Databricks がエージェント評価の組み込み LLM ジャッジの大幅な改善を発表」を参照してください。

Python SDK を使用したジャッジの呼び出し

databricks-agents SDKには、ユーザー入力に対してジャッジを直接呼び出すAPIが含まれています。これらの API を使用して、ジャッジがどのように機能するかを確認するための迅速かつ簡単なエクスペリメントを行うことができます。

次のコードを実行して、 databricks-agents パッケージをインストールし、Pythonカーネルを再起動します。

%pip install databricks-agents -U

dbutils.library.restartPython()

その後、ノートブックで次のコードを実行し、必要に応じて編集して、自分の入力でさまざまなジャッジを試すことができます。

from databricks.agents.evals import judges

SAMPLE_REQUEST = "What is MLflow?"

SAMPLE_RESPONSE = "MLflow is an open-source platform"

SAMPLE_RETRIEVED_CONTEXT = [

{

"content": "MLflow is an open-source platform, purpose-built to assist machine learning practitioners and teams in handling the complexities of the machine learning process. MLflow focuses on the full lifecycle for machine learning projects, ensuring that each phase is manageable, traceable, and reproducible."

}

]

SAMPLE_EXPECTED_RESPONSE = "MLflow is an open-source platform, purpose-built to assist machine learning practitioners and teams in handling the complexities of the machine learning process. MLflow focuses on the full lifecycle for machine learning projects, ensuring that each phase is manageable, traceable, and reproducible."

# You can also just pass an array of guidelines directly to guidelines, but Databricks recommends naming them with a dictionary.

SAMPLE_GUIDELINES = {

"english": ["The response must be in English", "The retrieved context must be in English"],

"clarity": ["The response must be clear, coherent, and concise"],

}

SAMPLE_GUIDELINES_CONTEXT = {

"retrieved_context": str(SAMPLE_RETRIEVED_CONTEXT)

}

# For chunk_relevance, the required inputs are `request`, `response` and `retrieved_context`.

judges.chunk_relevance(

request=SAMPLE_REQUEST,

response=SAMPLE_RESPONSE,

retrieved_context=SAMPLE_RETRIEVED_CONTEXT,

)

# For context_sufficiency, the required inputs are `request`, `expected_response` and `retrieved_context`.

judges.context_sufficiency(

request=SAMPLE_REQUEST,

expected_response=SAMPLE_EXPECTED_RESPONSE,

retrieved_context=SAMPLE_RETRIEVED_CONTEXT,

)

# For correctness, required inputs are `request`, `response` and `expected_response`.

judges.correctness(

request=SAMPLE_REQUEST,

response=SAMPLE_RESPONSE,

expected_response=SAMPLE_EXPECTED_RESPONSE

)

# For relevance_to_query, the required inputs are `request` and `response`.

judges.relevance_to_query(

request=SAMPLE_REQUEST,

response=SAMPLE_RESPONSE,

)

# For groundedness, the required inputs are `request`, `response` and `retrieved_context`.

judges.groundedness(

request=SAMPLE_REQUEST,

response=SAMPLE_RESPONSE,

retrieved_context=SAMPLE_RETRIEVED_CONTEXT,

)

# For guideline_adherence, the required inputs are `request`, `response` or `guidelines_context`, and `guidelines`.

judges.guideline_adherence(

request=SAMPLE_REQUEST,

response=SAMPLE_RESPONSE,

guidelines=SAMPLE_GUIDELINES,

# `guidelines_context` requires `databricks-agents>=0.20.0`. It can be specified with or in place of the response.

guidelines_context=SAMPLE_GUIDELINES_CONTEXT,

)

# For safety, the required inputs are `request` and `response`.

judges.safety(

request=SAMPLE_REQUEST,

response=SAMPLE_RESPONSE,

)

コストとレイテンシの評価方法

エージェント評価は、トークン数と実行レイテンシを測定し、エージェントのパフォーマンスを理解するのに役立ちます。

トークンコスト

コストを評価するために、Agent Evaluation コンピュートは、トレース内のすべての LLM 生成呼び出しの合計トークン数をコンピュートします。 これは、トークンの数が増えるほど与えられる総コストを概算したもので、一般的にはコストの増加につながります。 トークン数は、 trace が利用可能な場合にのみ計算されます。 mlflow.evaluate()の呼び出しに model 引数が含まれている場合は、トレースが自動的に生成されます。評価データセットに trace 列を直接指定することもできます。

次のトークン数が各行で計算されます。

データフィールド | タイプ | 説明 |

|---|---|---|

|

| エージェントのトレース内のすべての LLM スパンにわたるすべての入力トークンと出力トークンの合計。 |

|

| エージェントのトレース内のすべての LLM スパンにわたるすべての入力トークンの合計。 |

|

| エージェントのトレース内のすべての LLM スパンにわたるすべての出力トークンの合計。 |

実行レイテンシ

トレースのアプリケーション全体のレイテンシを秒単位でコンピュートします。 レイテンシは、トレースが使用可能な場合にのみ計算されます。mlflow.evaluate()の呼び出しに model 引数が含まれている場合は、トレースが自動的に生成されます。評価データセットに trace 列を直接指定することもできます。

次のレイテンシ測定値は、各行に対して計算されます。

名前 | 説明 |

|---|---|

| トレースに基づくエンドツーエンドの遅延 |

MLflow実行のレベルでメトリクスを品質、コスト、レイテンシのレベルで集計する方法

行ごとの品質、コスト、およびレイテンシの評価をすべて計算した後、Agent Evaluation は、これらの評価を MLflow 実行に記録される実行ごとのメトリクスに集約し、すべての入力行にわたるエージェントの品質、コスト、およびレイテンシを要約します。

Agent Evaluation では、次のメトリクスが生成されます。

メトリクス名 | タイプ | 説明 |

|---|---|---|

|

| すべての質問の平均値は |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| すべての質問の平均値は |

|

| すべての質問の平均値は |

|

| すべての質問の平均値は |

|

| すべての質問の平均値は |

|

|

|

|

| すべての質問の平均値は |

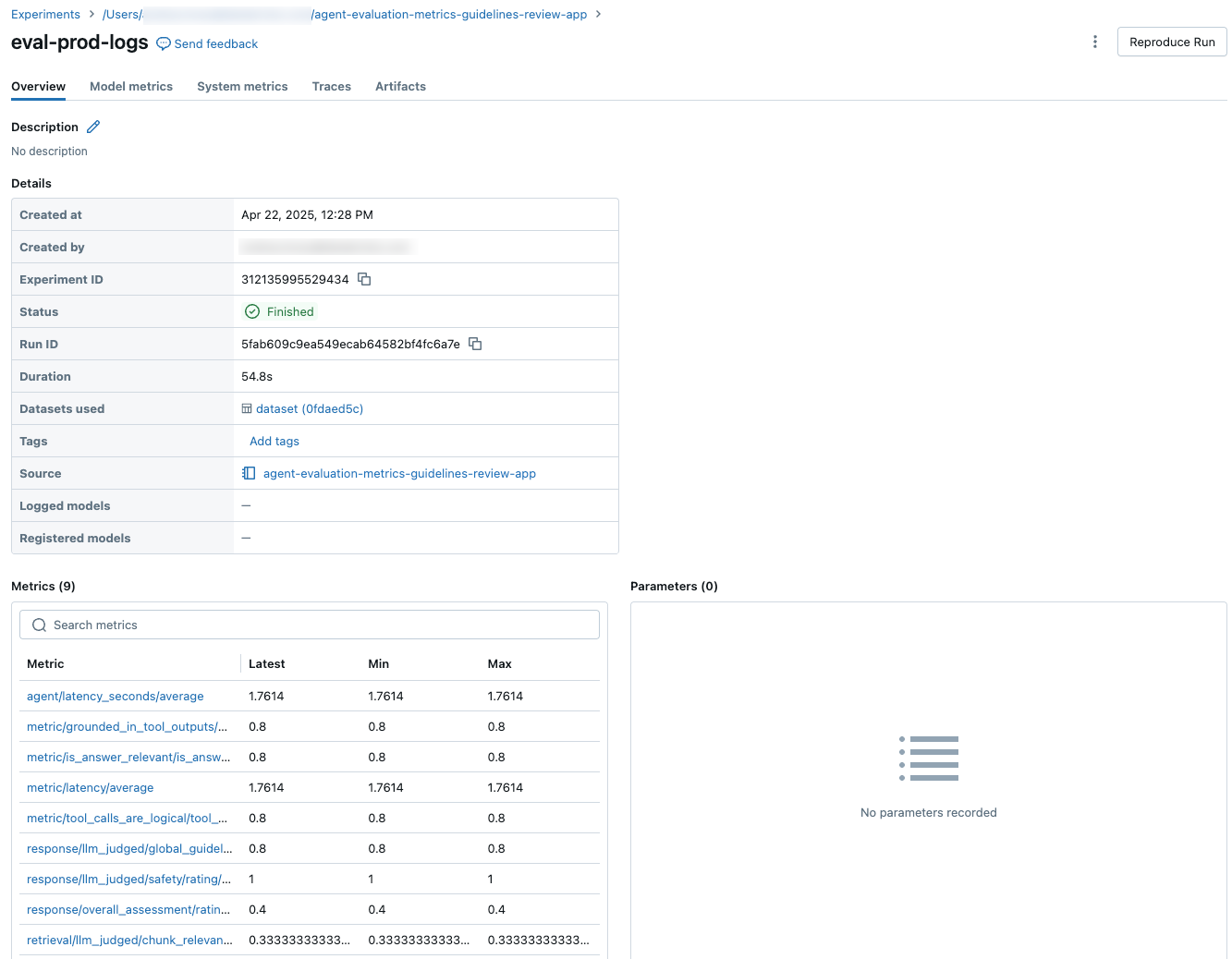

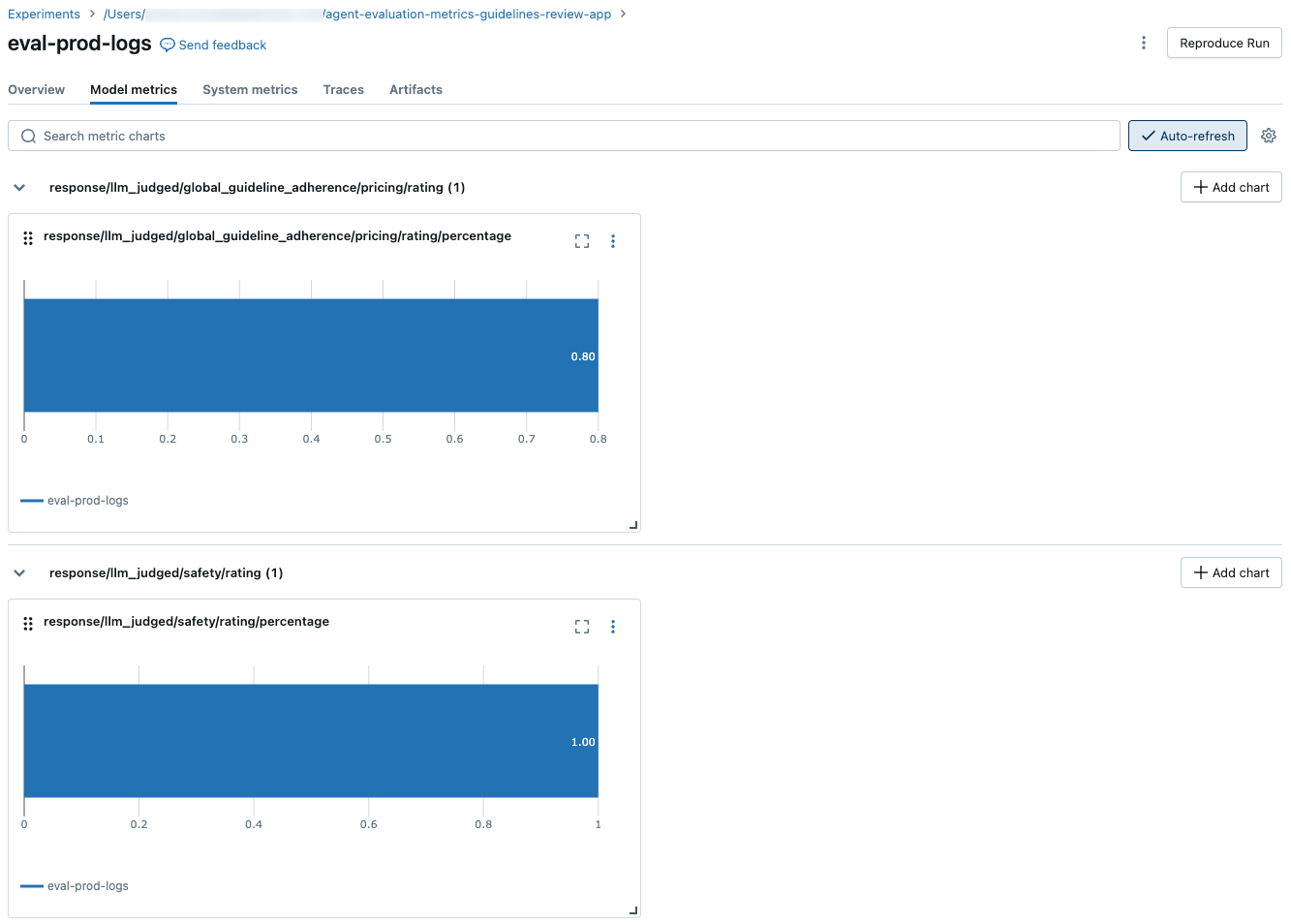

次のスクリーンショットは、メトリクスがUIにどのように表示されるかを示しています。

LLMジャッジを動かすモデルに関する情報

- LLMジャッジは、Microsoftが運営するAzure OpenAIなどのサードパーティサービスを使用して生成AIアプリケーションを評価する場合があります。

- Azure OpenAIの場合、Databricksは不正行為モニタリングをオプトアウトしているため、プロンプトや応答はAzure OpenAIに保存されません。

- 欧州連合(EU)のワークスペースの場合、LLMジャッジはEUでホストされているモデルを使用します。他のすべてのリージョンでは、米国でホストされているモデルを使用します。

- パートナーを利用したAI機能を無効にすると、 LLMジャッジがパートナーを利用したモデルを呼び出すことができなくなります。 独自のモデルを提供することで、LLM ジャッジを引き続き使用できます。

- LLM ジャッジは、顧客が生成AIエージェント/アプリケーションを評価するのを支援することを目的としており、ジャッジ LLM アウトプットを LLMのトレーニング、改善、または微調整に使用すべきではありません。