O que é o Unity Catalog?

O Unity Catalog é a camada de governança unificada integrada ao Databricks. Quando ativado para um workspace, Unity Catalog opera automaticamente em todas as interações de dados no seu espaço de trabalho: aplicando controle de acesso ao consultar uma tabela, acompanhando a linhagem à medida que os dados são movidos, registrando atividades para auditoria e muito mais. Você trabalha com os objetos gerenciados pelo Unity Catalog por meio do Catalog Explorer, SQL, da CLI do Databricks e das APIs REST.

O Unity Catalog também está disponível como uma implementação de código aberto. Veja os blogs de anúncios e o Unity Catalog GitHub repositório público.

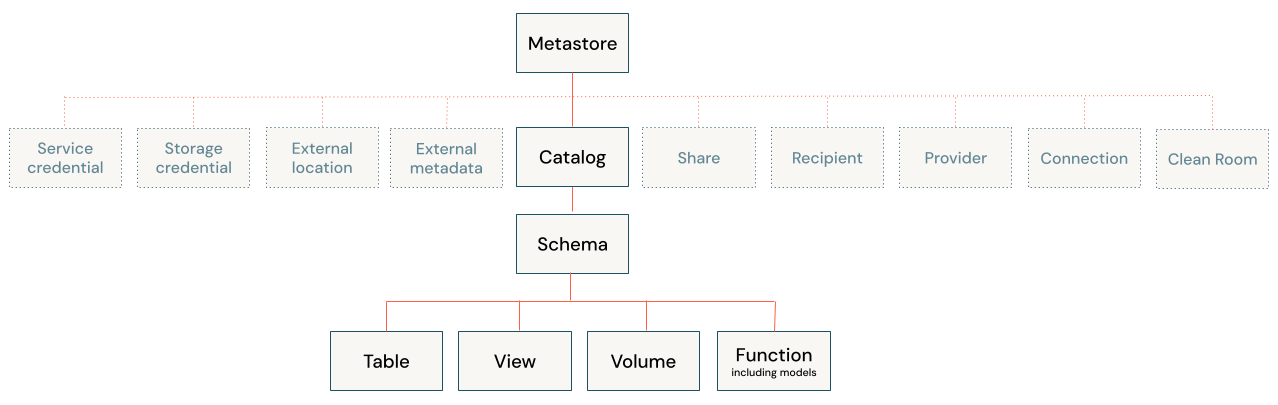

O modelo de objeto Unity Catalog

Cada atividade que você gerencia no Unity Catalog é modelada como um objeto protegível , um objeto no qual você pode conceder permissões a usuários, entidades de serviço ou grupos. Os dados ativos, como tabelas, visualizações, volumes, funções e modelos, seguem um namespace de três níveis (catalog.schema.object). Tabelas e volumes podem ser gerenciados internamente , onde Unity Catalog lida tanto com a governança quanto com o ciclo de vida subjacente do armazenamento de arquivos, ou externamente , onde Unity Catalog lida apenas com a governança. Outros objetos, como credenciais de armazenamento, locais externos, conexões e compartilhamentos, ficam diretamente abaixo do metastore.

As páginas seguintes explicam com mais detalhes os conceitos principais Unity Catalog e o fluxo de trabalho.

-

- Objetos protegíveis

- Aprenda sobre cada tipo de objeto na hierarquia Unity Catalog e como as permissões se aplicam a eles.

-

- gerenciamento versus ativo externo

- Entenda a diferença entre tabelas e volumes gerenciados e externos, e quando usar cada um.

-

- Requisitos e limitações

- Analise os requisitos compute , os formatos de arquivo suportados, as restrições de nomenclatura e as limitações conhecidas.

RecursosUnity Catalog

Unity Catalog fornece ferramentas integradas para gerenciar todas as dimensões do seu ambiente de dados e AI . Os tópicos a seguir abrangem as principais áreas de competência.

-

- Controle de acesso

- Gerencie quem pode acessar o quê usando privilégios, políticas baseadas em atributos, filtros de linha e coluna e vinculações de workspace .

-

- Descobrimento de dados

- Interaja com objetos protegíveis usando o Catalog Explorer, a interface de usuário Databricks para descobrir e gerenciar dados e ativos AI registrados no Unity Catalog.

-

- Linhagem de dados

- Acompanhe automaticamente o fluxo e a transformação dos dados, da origem à visualização final e aos painéis de controle.

-

- Auditoria

- Mantenha um registro completo de todos os acessos a dados e atividades do sistema usando a tabela log auditoria do sistema.

-

- Classificação de dados

- Classifique e tag automaticamente os dados sensíveis em seu catálogo.

-

- Monitoramento da qualidade dos dados

- Monitore proativamente a integridade dos dados com criação de perfis e alertas integrados que detectam anomalias antes que elas cheguem aos consumidores subsequentes.

-

- Data Sharing

- Compartilhe dados em tempo real e atividades AI de forma segura entre organizações e clouds usando o protocolo aberto Delta Sharing .

-

- governança AI

- Controle a atividade da AI e o tráfego AI usando Unity Catalog e AI Gateway.

Comece agora

O recurso a seguir ajudará você a começar a usar Unity Catalog. Se o seu workspace foi criado após 8 de novembro de 2023, ele será ativado automaticamente com Unity Catalog.

-

- Comece a usar o Unity Catalog

- Verifique se Unity Catalog já está habilitado para seu workspace e configure seu primeiro catálogo, esquema e controles de acesso a dados.

-

- Atualize para Unity Catalog

- Aprenda como atualizar um workspace que ainda não está usando Unity Catalog.