O que é um data lakehouse?

O data lakehouse é um sistema de gerenciamento de dados que combina os benefícios do data lake e do data warehouse. Este artigo descreve o padrão arquitetônico lakehouse e o que o senhor pode fazer com ele em Databricks.

Para que serve um data lakehouse?

O site data lakehouse oferece recursos de armazenamento e processamento dimensionáveis para organizações modernas que desejam evitar sistemas isolados para o processamento de diferentes cargas de trabalho, como aprendizado de máquina (ML) e Business Intelligence (BI). Um data lakehouse pode ajudar a estabelecer uma única fonte de verdade, eliminar custos redundantes e garantir o frescor dos dados.

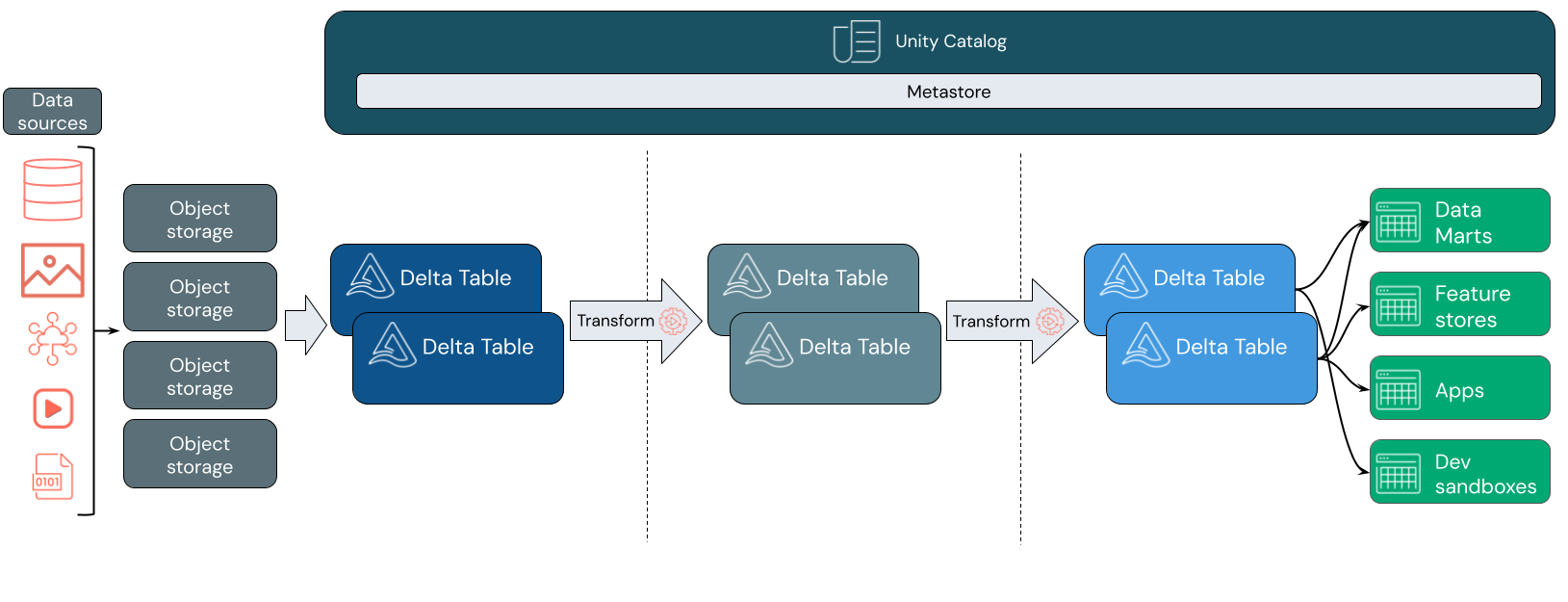

Os data lakehouses geralmente usam um padrão de design de dados que melhora, enriquece e refina os dados de forma incremental à medida que eles passam por camadas de preparação e transformações. Cada camada do site lakehouse pode incluir uma ou mais camadas. Esse padrão é frequentemente chamado de arquitetura de medalhão. Para obter mais informações, consulte O que é o medalhão da arquitetura lakehouse?

Como funciona o site Databricks lakehouse ?

O Databricks é construído no Apache Spark. Apache Spark permite um mecanismo altamente escalável que executa recursos compute desacoplados do armazenamento. Para obter mais informações, consulte Visão geralApache Spark

O Databricks lakehouse usa duas tecnologias adicionais key:

- Delta LakeO senhor tem uma camada de armazenamento otimizada que suporta transações ACID e imposição de esquema.

- Unity Catalog: uma solução de governança unificada e refinada para dados e AI.

ingestão de dados

Na camada de ingestão, os lotes ou dados de transmissão chegam de diversas fontes e em diversos formatos. Essa primeira camada lógica fornece um local para esses dados chegarem em seu formato bruto. Ao converter esses arquivos em tabelas Delta, o senhor pode usar os recursos de imposição de esquema do Delta Lake para verificar se há dados ausentes ou inesperados. O senhor pode usar o site Unity Catalog para registrar tabelas de acordo com o seu modelo de governança de dados e os limites de isolamento de dados necessários. O Unity Catalog permite que o senhor rastreie a linhagem dos seus dados à medida que eles são transformados e refinados, além de aplicar um modelo de governança unificado para manter os dados confidenciais privados e seguros.

Processamento, curadoria e integração de dados

Uma vez verificado, o senhor pode começar a selecionar e refinar seus dados. data scientists e os profissionais de aprendizado de máquina frequentemente trabalham com dados nesse estágio para começar a combinar ou criar novos recursos e completar a Limpeza de dados. Depois que seus dados forem completamente limpos, eles poderão ser integrados e reorganizados em tabelas projetadas para atender às suas necessidades comerciais específicas.

Uma abordagem de schema-on-write, combinada com os recursos de Delta evolução do esquema, significa que o senhor pode fazer alterações nessa camada sem necessariamente ter que reescrever a lógica downstream que fornece dados aos usuários finais.

Servidão de dados

A camada final fornece dados limpos e enriquecedores aos usuários finais. As tabelas finais devem ser projetadas para fornecer dados para todos os seus casos de uso. Um modelo de governança unificado significa que o senhor pode rastrear a linhagem de dados até a fonte única da verdade. A disposição de dados, otimizada para diferentes tarefas, permite que os usuários finais acessem dados para aplicativos de aprendizado de máquina, engenharia de dados, Business Intelligence e relatórios.

Para saber mais sobre o Delta Lake, consulte O que é o Delta Lake na Databricks? Para saber mais sobre o Unity Catalog, consulte O que é o Unity Catalog?

Capacidades de um Databricks lakehouse

O site lakehouse, desenvolvido em Databricks, substitui a dependência atual do data lake e do data warehouse das empresas de dados modernas. Algumas key tarefas que o senhor pode realizar incluem:

- Processamento de dados em tempo real: Processar dados de transmissão em tempo real para análise e ação imediatas.

- integração de dados: Unifique seus dados em um único sistema para permitir a colaboração e estabelecer uma única fonte de verdade para sua organização.

- evolução do esquema: Modificar o esquema de dados ao longo do tempo para se adaptar às necessidades comerciais em constante mudança sem interromper o pipeline de dados existente.

- Transformações de dados: O uso dos sites Apache Spark e Delta Lake traz velocidade, escalabilidade e confiabilidade aos seus dados.

- Análise de dados e geração de relatórios: execução de consultas analíticas complexas com um mecanismo otimizado para cargas de trabalho do data warehousing.

- Aprendizado de máquina e AI : Aplique técnicas analíticas avançadas a todos os seus dados. Use o ML para enriquecer seus dados e dar suporte a outras cargas de trabalho.

- Controle de versão e linhagem de dados: Manter o histórico de versões do conjunto de dados e rastrear a linhagem para garantir a proveniência e a rastreabilidade dos dados.

- governança de dados: Use um sistema único e unificado para controlar o acesso aos seus dados e realizar auditorias.

- compartilhamento de dados: Facilite a colaboração, permitindo o compartilhamento de conjuntos de dados, relatórios e percepções com curadoria entre as equipes.

- Análise operacional: Monitore análises de qualidade de dados, análises de qualidade de modelo e desvios usando monitoramento de qualidade de dados.

lakehouse vs data lake vs data warehouse

(BI) há cerca de 30 anos, tendo evoluído como um conjunto de diretrizes de design para sistemas que controlam o fluxo de dados. O data warehouse corporativo otimiza as consultas para os relatórios do BI, mas pode levar minutos ou até horas para gerar resultados. Projetado para dados que provavelmente não serão alterados com alta frequência, o data warehouse procura evitar conflitos entre consultas executadas simultaneamente. Muitos data warehouse dependem de formatos proprietários, que geralmente limitam o suporte ao aprendizado de máquina. O data warehousing em Databricks aproveita os recursos de um Databricks lakehouse e Databricks SQL. Para obter mais informações, consulte data warehousing em Databricks.

Impulsionados pelos avanços tecnológicos no campo de armazenamento de dados e pelos aumentos exponenciais nos tipos e volumes de dados, os data lakes tornaram-se amplamente utilizados na última década. Os data lakes armazenam e processam dados de maneira barata e eficiente. Os data lakes são frequentemente definidos em oposição aos data warehouses: um data warehouse fornece dados limpos e estruturados para análise de BI, enquanto um data lake armazena dados de qualquer natureza de forma permanente e barata em qualquer formato. Muitas organizações usam data lakes para ciência de dados e machine learning, mas não para relatórios de BI devido à sua natureza não validada.

O data lakehouse combina os benefícios do data lake e do data warehouse e oferece:

- Acesso direto e imediato aos dados armazenados em formatos de dados padrão.

- Protocolos de indexação otimizados para machine learning e ciência de dados.

- Baixa latência de consulta e alta confiabilidade para BI e funções analíticas avançadas.

Ao combinar uma camada de metadados otimizada com dados validados armazenados em formatos padrão no armazenamento de objetos cloud , o data lakehouse permite que você trabalhe com os mesmos dados e na mesma plataforma em diferentes casos de uso.

Próxima etapa

Para saber mais sobre os princípios e as práticas recomendadas para implementar e operar um lakehouse usando Databricks, consulte Introdução ao Well-Architected data lakehouse