visualizar, gerenciar e analisar o Foundation Model Fine-tuning execução

Visualização

Esse recurso está em Public Preview em us-east-1 e us-west-2.

Este artigo descreve como view, gerenciar e analisar a execução do Foundation Model Fine-tuning (agora parte do Mosaic AI Model treinamento) usando APIs ou usando a UI.

Para obter informações sobre a criação de execução, consulte Criar um treinamento execução usando o Foundation Model Fine-tuning API e Criar um treinamento execução usando o Foundation Model Fine-tuning UI.

Use o ajuste fino do modelo da fundação APIs para view e gerenciar a execução do treinamento

O Foundation Model Fine-tuning APIs oferece as seguintes funções para gerenciar seu treinamento execution.

Obter uma execução

Use a função get() para retornar uma execução por nome ou um objeto de execução que você iniciou.

from databricks.model_training import foundation_model as fm

fm.get('<your-run-name>')

Lista de execução

Use a função list() para ver as execuções que você iniciou. A tabela a seguir lista os filtros opcionais que você pode especificar.

Filtro opcional | Definição |

|---|---|

| Uma lista de execuções a usar. O padrão é selecionar todas as execuções. |

| Se as execuções compartilhadas estiverem ativadas para o seu workspace, você poderá filtrar os resultados pelo usuário que enviou a execução de treinamento. O default é nenhum filtro de usuário. |

| Uma data e hora ou string de data e hora para filtrar execuções anteriores. O default é todas as execuções. |

| Uma data e hora ou string de data e hora para filtrar execuções posteriores. O default é todas as execuções. |

from databricks.model_training import foundation_model as fm

fm.list()

# filtering example

fm.list(before='2023-01-01', limit=50)

Cancelar treinamento execução

Para cancelar uma única execução de treinamento, use a função cancel() e passe o nome da execução.

from databricks.model_training import foundation_model as fm

run_to_cancel = '<name-of-run-to-cancel>'

fm.cancel(run_to_cancel)

Para cancelar várias execuções de treinamento, passe os nomes das execuções específicas como uma lista.

from databricks.model_training import foundation_model as fm

runs_to_cancel = ['<run_1>, <run_2>, <run_3>']

fm.cancel(runs=runs_to_cancel)

Para cancelar todas as execuções de treinamento em um experimento, passe o ID do experimento.

from databricks.model_training import foundation_model as fm

experiment_to_cancel = '<experiment-id-to-cancel>'

fm.cancel(experiment_id=experiment_to_cancel)

Revisão do status do treinamento execução

A tabela a seguir lista os eventos criados por uma execução de treinamento. Use a função get_events() a qualquer momento durante sua execução para ver o progresso da execução.

O ajuste fino do Foundation Model impõe um limite de 10 execuções ativas. Essas execuções estão na fila, em execução ou terminando. execução não são mais considerados ativos depois de estarem no estado COMPLETED, FAILED ou STOPPED.

Tipo de evento | Exemplo de mensagem de evento | Definição |

|---|---|---|

| Execução criada. | A execução de treinamento foi criada. Se houver recursos disponíveis, a execução é iniciada. Caso contrário, ela entrará no estado |

| A execução começou. | Os recursos foram alocados e a execução começou. |

| Dados de treinamento validados. | Foi validado que os dados de treinamento estão formatados corretamente. |

| Dados do modelo baixados e inicializados para o modelo base | Os pesos para o modelo base foram baixados e o treinamento está pronto para começar. |

| [epoch=1/1][batch=50/56][ETA=5min] Perda de treinamento loss: 1,71 | Relata o lote, a época ou o token do treinamento atual, o tempo estimado para a conclusão do treinamento (sem incluir o tempo de upload do ponto de verificação) e a perda de treinamento. Esse evento é atualizado quando cada lote termina. Se a configuração de execução especificar |

| Treinamento concluído. | O treinamento terminou. O upload do ponto de verificação é iniciado. |

| Execução concluída. Os pesos finais foram carregados. | O ponto de verificação foi carregado e a execução foi concluída. |

| Execução cancelada. | A execução será cancelada se ela chamar |

| Uma ou mais amostras de conjuntos de dados de treinamento têm chaves desconhecidas. Consulte a documentação para saber os formatos de dados compatíveis. | A execução falhou. Consulte |

from databricks.model_training import foundation_model as fm

fm.get_events()

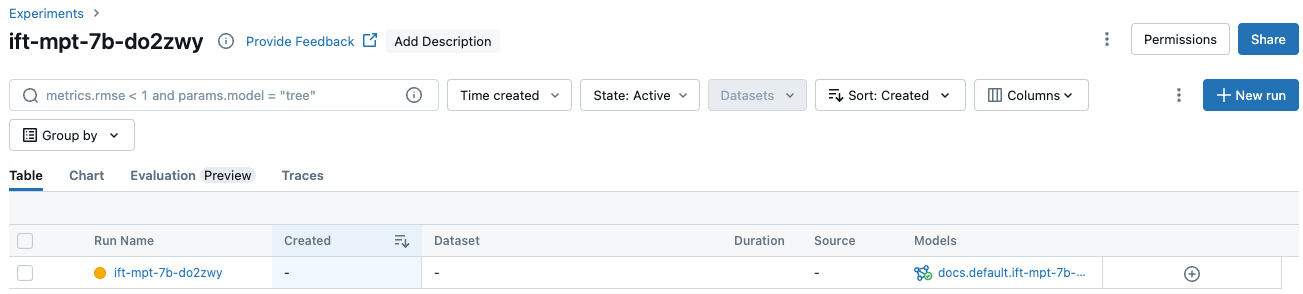

Use a UI para view e gerenciar a execução

Para ver execuções na interface do usuário:

-

Clique em Experimentos na barra de navegação esquerda para exibir a página Experimentos.

-

Na tabela, clique no nome do seu experimento para exibir a página do experimento. A página do experimento lista todas as execuções associadas ao experimento.

-

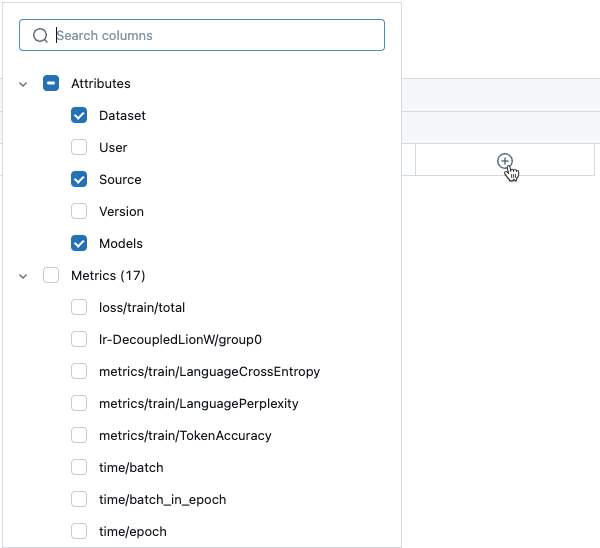

Para exibir mais informações ou métricas na tabela, clique em

e selecione os itens a serem exibidos no menu:

-

Há mais informações sobre a execução disponíveis na tab Gráfico :

💹

-

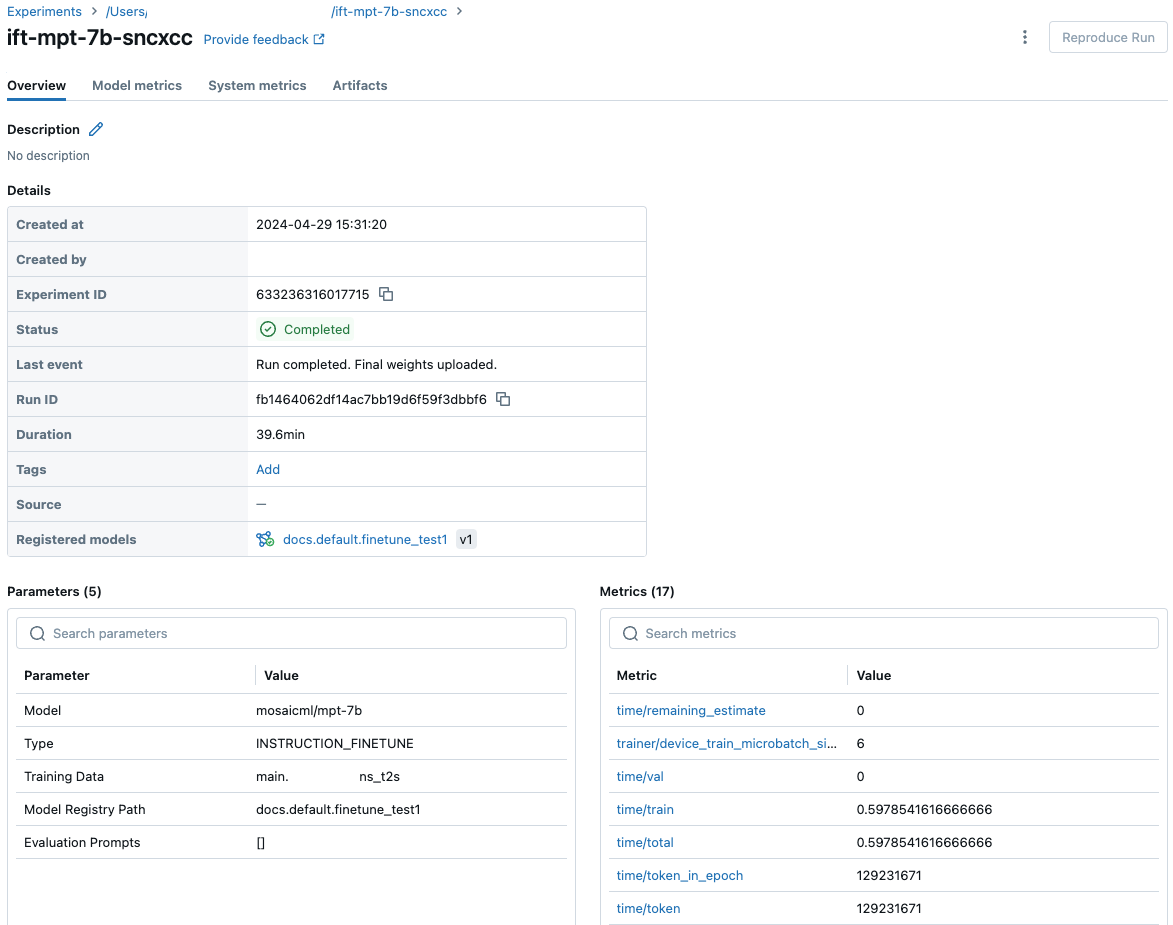

Você pode clicar também no nome da execução para exibir a tela de execução. Essa tela dá acesso a mais detalhes sobre a execução.

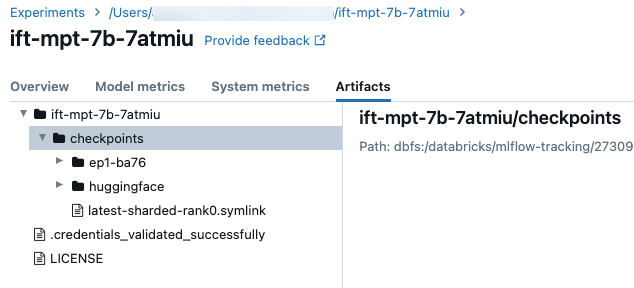

Pontos de verificação

Para acessar a pasta de pontos de verificação, clique na guia Artefatos na tela de execução. Abra o nome do experimento e depois a pasta de pontos de verificação . Esses pontos de verificação de artefatos não são os mesmos que o modelo registrado no final de uma execução de treinamento.

Existem alguns diretórios nesta pasta:

- As pastas epoch (denominadas

ep<n>-xxx) contêm os pesos e os estados do modelo em cada ponto de verificação. Os pontos de controle são salvos periodicamente durante o treinamento, sendo usados para retomar uma execução de treinamento de ajuste fino e para continuar o ajuste fino. Esse ponto de verificação é o que o senhor passa comocustom_weights_pathpara começar outro treinamento execução a partir desses pesos, consulte Construir pesos de modelos personalizados. - O

checkpoints/latest-sharded-rank0.symlinké um arquivo que contém o caminho para o último ponto de verificação, que você pode usar para retomar o treinamento.

O senhor também pode obter os pontos de controle de uma execução depois que eles forem salvos usando get_checkpoints(run). Essa função recebe o objeto execução como entrada. Se os pontos de verificação ainda não existirem, você será solicitado a tentar novamente depois que os pontos de verificação forem salvos.