Gerenciar o ciclo de vida do modelo usando o site Workspace Model Registry (legado)

Esta documentação abrange o Workspace Model Registry. Se o seu workspace estiver habilitado para Unity Catalog, não use os procedimentos desta página. Em vez disso, consulte Modelos no Unity Catalog.

Para obter orientações sobre como fazer o upgrade do Workspace Model Registry para o Unity Catalog, consulte Migrar fluxo de trabalho e modelos para Unity Catalog.

Se workspace o default catálogo do seu estiver em Unity Catalog (em vez hive_metastore de) e o senhor estiver executando um clustering usando Databricks Runtime 13.3 LTS ou acima ou usando MLflow 3, os modelos serão automaticamente criados e carregados no workspace default catálogo , sem necessidade de configuração. Para usar o Workspace Model Registry nesse caso, o senhor deve direcioná-lo explicitamente executando import mlflow; mlflow.set_registry_uri("databricks") no início da sua carga de trabalho. Um pequeno número de espaços de trabalho em que tanto o catálogo default foi configurado para um catálogo em Unity Catalog antes de janeiro de 2024 quanto o registro de modelo workspace foi usado antes de janeiro de 2024 estão isentos desse comportamento e continuam a usar o Workspace Model Registry por default.

A partir de abril de 2024, Databricks o desativou o Workspace Model Registry para o workspace default espaço de trabalho em uma nova conta em que o catálogo do está Unity Catalog em.

Este artigo descreve como usar o Workspace Model Registry como parte de seu fluxo de trabalho machine learning para gerenciar o ciclo de vida completo dos modelos de ML. O Workspace Model Registry é uma versão hospedada fornecida pelo Databricks do MLflow Model Registry.

O Workspace Model Registry continua sendo compatível com o MLflow 3 e com o MLflow 2.x. Com MLflow 3, o URI do registro default é databricks-uc, o que significa que o MLflow Model Registry em Unity Catalog será usado. Para usar o Workspace Model Registry, o senhor deve chamar mlflow.set_registry_uri("databricks"). Para obter mais detalhes, consulte Registro de modelos.

O Workspace Model Registry fornece:

- Linhagem do modelo cronológico (qual experimento e execução do MLflow produziu o modelo em um determinado momento).

- servindo modelo.

- Versionamento de modelo.

- transição de estágio (por exemplo, de staging para produção ou arquivado).

- Webhooks para que você possa acionar ações automaticamente com base nos eventos do registro.

- notificações por e-mail de eventos do modelo.

O senhor também pode criar e view descrições de modelos e deixar comentários.

Este artigo inclui instruções para o Workspace Model Registry UI e o Workspace Model Registry API.

Para obter uma visão geral dos conceitos do Workspace Model Registry, consulte MLflow para o ciclo de vida do modelo de ML.

Criar ou registrar um modelo

O senhor pode criar ou registrar um modelo usando a interface do usuário, ou registrar um modelo usando o site API.

Criar ou registrar um modelo usando a UI

Há duas maneiras de registrar um modelo no Workspace Model Registry. Você pode registrar um modelo existente que foi logs no MLflow ou pode criar e registrar um novo modelo vazio e, em seguida, atribuir logs modelos anteriores a ele.

registrar um modelo existente registrado em um Notebook

-

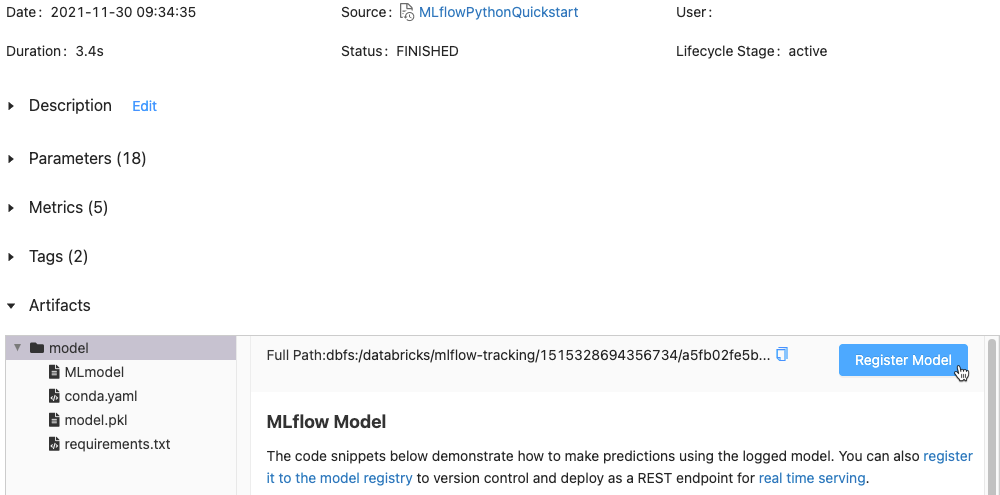

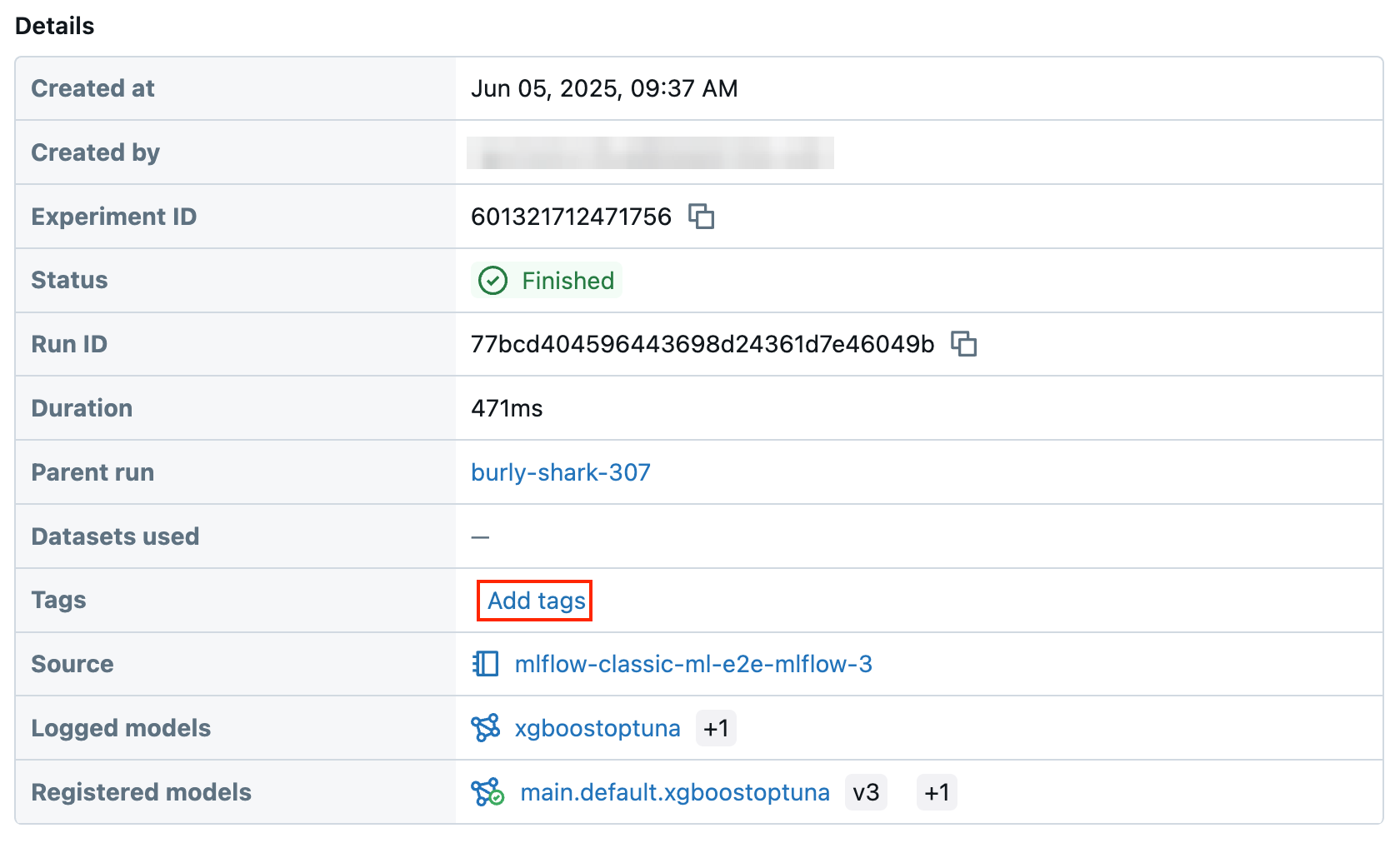

No espaço de trabalho, identifique a MLflow execução que contém o modelo que o senhor deseja registrar.

-

Clique no ícone de experimento

na barra lateral direita do Notebook.

-

Na barra lateral Experiment Execution, clique no ícone

ao lado da data da execução. A página MLflow execução é exibida. Essa página mostra detalhes da execução, incluindo parâmetros, métricas, tags e lista de artefatos.

-

-

Na seção Artefatos, clique no diretório chamado xxx-model .

-

Clique no botão registrar modelo na extrema direita.

-

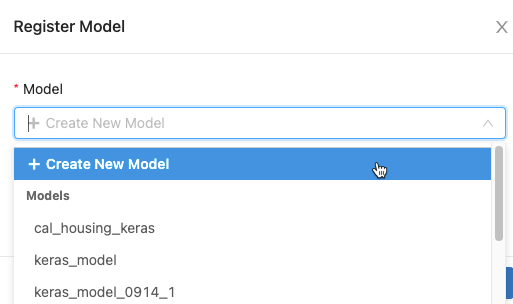

Na caixa de diálogo, clique na caixa Modelo e faça o seguinte:

- Selecione Criar novo modelo no menu suspenso. O campo Nome do modelo é exibido. Insira um nome de modelo, por exemplo

scikit-learn-power-forecasting. - Selecione um modelo existente no menu suspenso.

- Selecione Criar novo modelo no menu suspenso. O campo Nome do modelo é exibido. Insira um nome de modelo, por exemplo

-

Clique em Registrar .

- Se você selecionou Create New Model , este registro de um modelo chamado

scikit-learn-power-forecasting, copia o modelo em um local seguro gerenciado pelo Workspace Model Registry e cria uma nova versão do modelo. - Se o senhor selecionou um modelo existente, isso registrará uma nova versão do modelo selecionado.

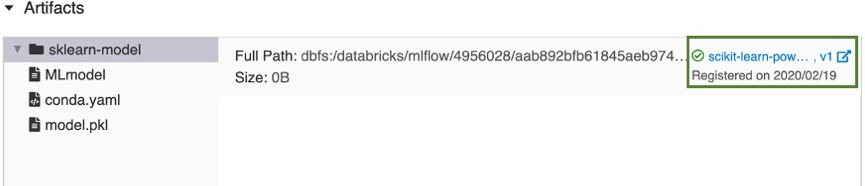

Após alguns instantes, o botão registrar modelo muda para um link para a nova versão do modelo registrado.

- Se você selecionou Create New Model , este registro de um modelo chamado

-

Clique no link para abrir a nova versão do modelo na UI do Workspace Model Registry. O senhor também pode encontrar o modelo no Workspace Model Registry clicando em

Models na barra lateral.

Crie um novo modelo registrado e atribua um modelo registrado a ele

O senhor pode usar o botão Create Model (Criar modelo) na página de modelos registrados para criar um modelo novo e vazio e, em seguida, atribuir um modelo registrado a ele. Siga estas etapas:

-

Na página de modelos registrados, clique em Criar modelo . Insira um nome para o modelo e clique em Criar .

-

Siga as etapas de 1 a 3 para registrar um modelo existente registrado a partir de um Notebook.

-

Na caixa de diálogo Modelo de Registro, selecione o nome do modelo que você criou na passo 1 e clique em registro . Este registro um modelo com o nome que você criou, copia o modelo em um local seguro gerenciado pelo Workspace Model Registry e cria uma versão do modelo:

Version 1.Após alguns instantes, a interface do usuário MLflow execução substitui o botão registrar modelo por um link para a nova versão do modelo registrado. Agora o senhor pode selecionar o modelo na lista suspensa Model ( Modelo ) na caixa de diálogo Registro Model (Modelo de registro) na página Execução do experimento . O senhor também pode registrar novas versões do modelo especificando seu nome em API comando como Create ModelVersion.

registrar um modelo usando o API

Existem três maneiras programáticas de registrar um modelo no Workspace Model Registry. Todos os métodos copiam o modelo para um local seguro gerenciado pelo Workspace Model Registry.

-

Para log um modelo e registrá-lo com o nome especificado durante um experimento MLflow, use o método

mlflow.<model-flavor>.log_model(...). Se não houver um modelo registrado com o nome, o método registrará um novo modelo, criará a Versão 1 e retornará um objetoModelVersionMLflow . Se um modelo registrado com o nome já existir, o método cria uma nova versão do modelo e retorna o objeto de versão.Pythonwith mlflow.start_run(run_name=<run-name>) as run:

...

mlflow.<model-flavor>.log_model(<model-flavor>=<model>,

artifact_path="<model-path>",

registered_model_name="<model-name>"

) -

Para registrar um modelo com o nome especificado depois que toda a execução do experimento estiver concluída e o senhor tiver decidido qual modelo é mais adequado para adicionar ao registro, use o método

mlflow.register_model(). Para esse método, o senhor precisa do ID de execução para o argumentomlruns:URI. Se não houver um modelo registrado com o nome, o método registrará um novo modelo, criará a Versão 1 e retornará um objetoModelVersionMLflow . Se um modelo registrado com o nome já existir, o método cria uma nova versão do modelo e retorna o objeto de versão.Pythonresult=mlflow.register_model("runs:<model-path>", "<model-name>") -

Para criar um novo modelo registrado com o nome especificado, use o método MLflow Client API

create_registered_model(). Se o nome do modelo existir, esse método lançará umMLflowException.Pythonclient = MlflowClient()

result = client.create_registered_model("<model-name>")

O senhor também pode registrar um modelo com o provedorDatabricks Terraform e databricks_mlflow_model.

Limites de cota

A partir de maio de 2024, para todo o espaço de trabalho Databricks, o Workspace Model Registry impõe limites de cota ao número total de modelos registrados e versões de modelos por workspace. Veja limites de recurso. Se exceder as cotas de registro, a Databricks recomenda que o usuário exclua os modelos registrados e as versões de modelos que não são mais necessários. A Databricks também recomenda que o senhor ajuste sua estratégia de registro e retenção de modelos para ficar abaixo do limite. Se o senhor precisar aumentar os limites do workspace, entre em contato com a equipe do Databricks account .

O seguinte Notebook ilustra como inventariar e excluir suas entidades de registro de modelo.

Inventário workspace registro de entidades modelo Notebook

modelos de visualização na interface do usuário

Página de modelos registrados

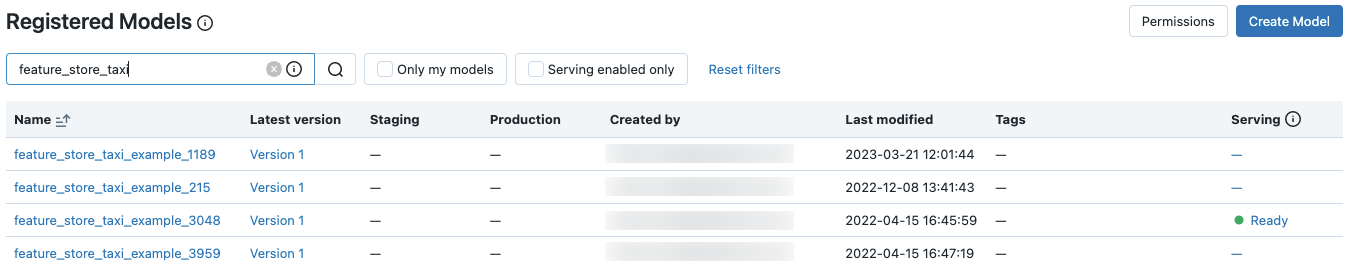

A página de modelos registrados é exibida quando você clica em Modelos na barra lateral. Esta página mostra todos os modelos no registro.

Você pode criar um novo modelo nesta página.

Também nessa página, os administradores do site workspace podem definir permissões para todos os modelos no site Workspace Model Registry.

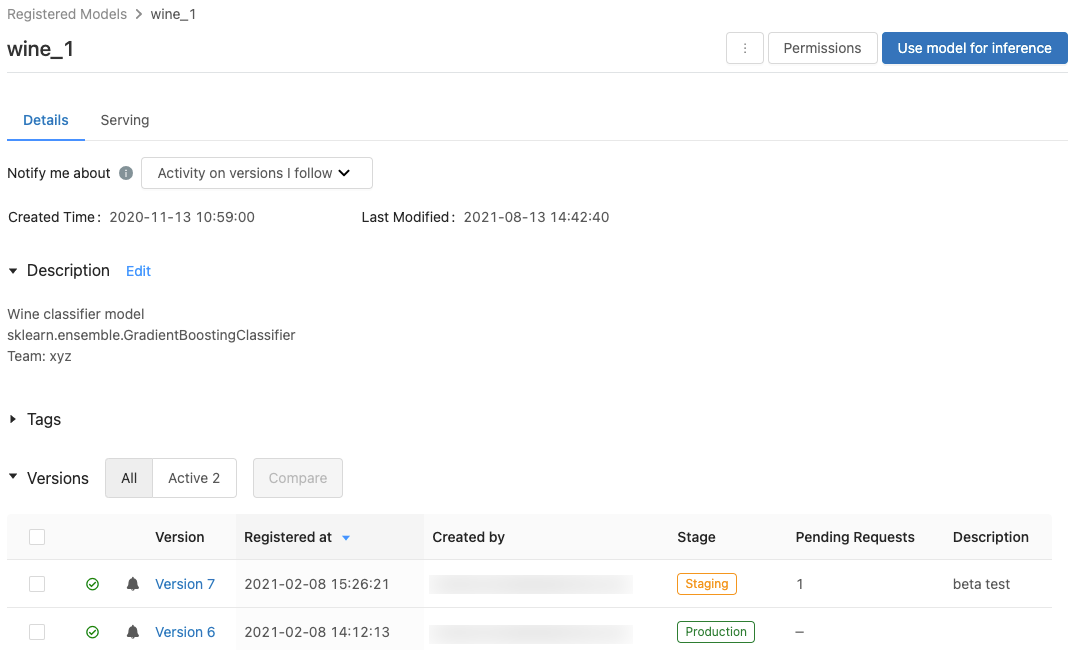

Página do modelo registrado

Para exibir a página do modelo registrado de um modelo, clique no nome do modelo na página de modelos registrados. A página do modelo registrado mostra informações sobre o modelo selecionado e uma tabela com informações sobre cada versão do modelo. Nessa página, você também pode:

- Configurar o modelo de serviço.

- Gerar automaticamente um Notebook para usar o modelo para inferência.

- Configure as notificações do site email.

- Compare as versões do modelo.

- Defina as permissões para o modelo.

- Exclua um modelo.

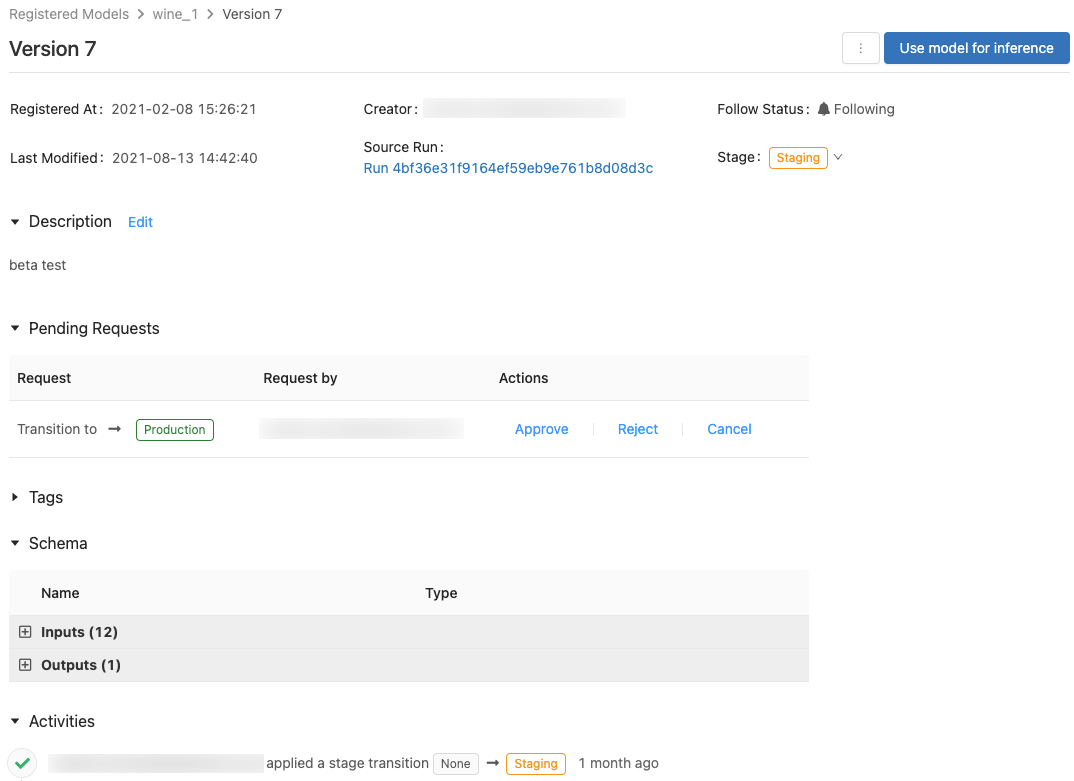

Página de versão do modelo

Para acessar view a página da versão do modelo, siga um destes procedimentos:

- Clique no nome de uma versão na coluna Versão mais recente na página de modelos registrados.

- Clique no nome de uma versão na coluna Versão na página do modelo registrado.

Essa página exibe informações sobre uma versão específica de um modelo registrado e também fornece um link para a execução de origem (a versão do Notebook que foi executada para criar o modelo). Nessa página, você também pode:

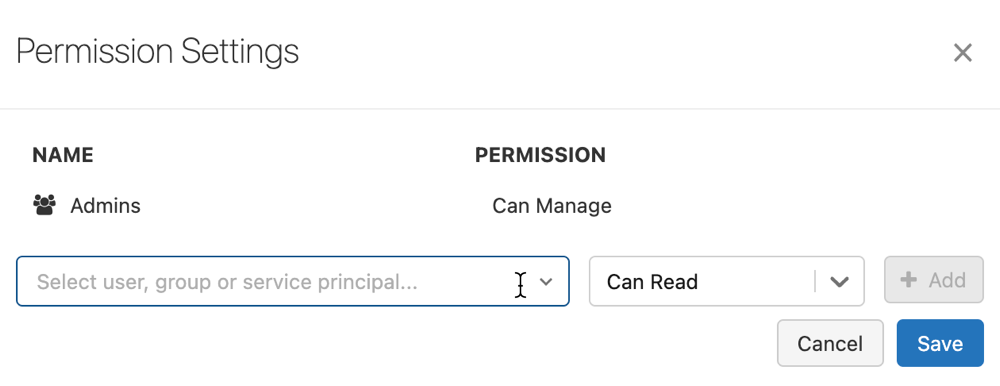

Controle o acesso aos modelos

O senhor deve ter pelo menos a permissão CAN MANAGE para configurar as permissões em um modelo. Para obter informações sobre os níveis de permissão do modelo, consulte MLflow model ACLs. Uma versão do modelo herda as permissões de seu modelo principal. Você não pode definir permissões para versões de modelo.

-

Na barra lateral, clique em

Modelos .

-

Selecione o nome do modelo.

-

Clique em Permissões . A caixa de diálogo Configurações de permissão é aberta.

-

Na caixa de diálogo, selecione o menu suspenso Select User, Group or entidade de serviço e selecione um usuário, grupo ou entidade de serviço.

-

Selecione uma permissão no menu suspenso de permissões.

-

Clique em Adicionar e clique em Salvar .

Os administradores do espaço de trabalho e os usuários com permissão CAN MANAGE no nível de todo o registro podem definir níveis de permissão em todos os modelos no workspace clicando em Permissions (Permissões ) na página Models (Modelos).

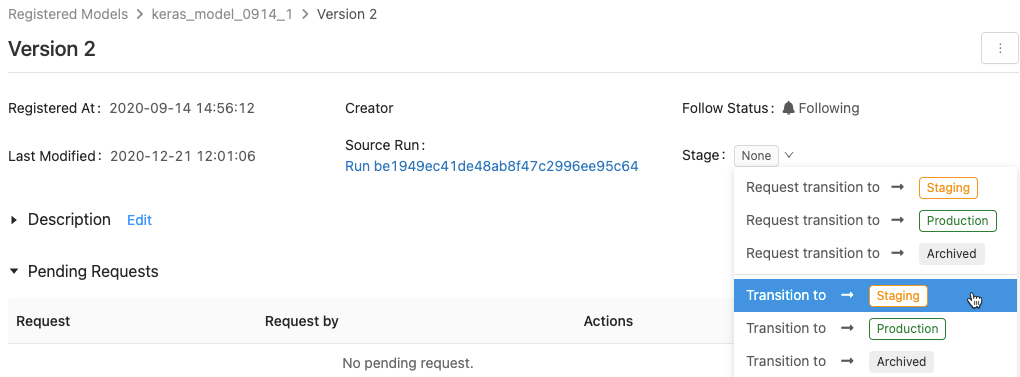

Transição de um estágio de modelo

Uma versão modelo tem um dos seguintes estágios: Nenhum, Preparação, Produção ou Arquivado. O estágio de preparação é destinado ao teste e à validação do modelo, enquanto o estágio de produção é para as versões do modelo que concluíram os processos de teste ou revisão e foram implantadas nos aplicativos para pontuação ao vivo. Supõe-se que uma versão do modelo arquivado esteja inativa. Nesse ponto, você pode considerar excluí-la. Versões diferentes de um modelo podem estar em diferentes estágios.

Um usuário com a permissão apropriada pode fazer a transição de uma versão do modelo entre os estágios. Se você tiver permissão para fazer a transição de uma versão do modelo para um estágio específico, poderá fazer a transição diretamente. Se o senhor não tiver permissão, poderá solicitar uma transição de estágio e um usuário que tenha permissão para fazer a transição de versões do modelo poderá aprovar, rejeitar ou cancelar a solicitação.

O senhor pode fazer a transição de um estágio de modelo usando a interface do usuário ou a API.

Faça a transição de um estágio de modelo usando a interface

Siga estas instruções para fazer a transição do estágio de um modelo.

-

Para exibir a lista de estágios de modelo disponíveis e suas opções disponíveis, em uma página de versão do modelo, clique na lista suspensa ao lado de Estágio: e solicite ou selecione uma transição para outro estágio.

-

Insira um comentário opcional e clique em OK .

Transição de uma versão do modelo para a fase de produção

Após o teste e a validação, você pode fazer a transição ou solicitar uma transição para a fase de produção.

Workspace Model Registry permite mais de uma versão do modelo registrado em cada estágio. Se quiser ter apenas uma versão em Produção, você pode fazer a transição de todas as versões do modelo atualmente em Produção para Arquivado marcando Transição das versões existentes do modelo de Produção para Arquivado .

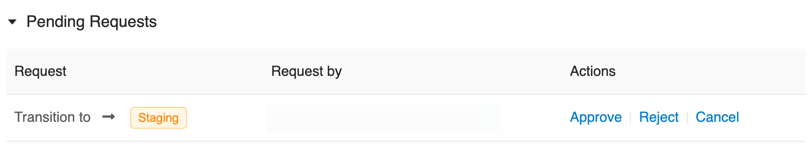

Aprovar, rejeitar ou cancelar uma solicitação de transição de estágio de versão de modelo

Um usuário sem permissão de transição de estágio pode solicitar uma transição de estágio. A solicitação aparece na seção Solicitações pendentes na página da versão do modelo:

Para aprovar, rejeitar ou cancelar uma solicitação de transição de estágio, clique no link Approve , Reject ou Cancel ( Aprovar, Rejeitar ou Cancelar ).

O criador de uma solicitação de transição também pode cancelar a solicitação.

visualizar atividades da versão do modelo

Para view todas as transições solicitadas, aprovadas, pendentes e aplicadas a uma versão de modelo, vá para a seção Activities (Atividades). Esse registro de atividades fornece uma linhagem do ciclo de vida do modelo para auditoria ou inspeção.

Transição de um estágio do modelo usando a API

Usuários com permissões apropriadas podem fazer a transição de uma versão do modelo para um novo estágio.

Para atualizar um estágio de versão de modelo para um novo estágio, use o método MLflow Client API transition_model_version_stage():

client = MlflowClient()

client.transition_model_version_stage(

name="<model-name>",

version=<model-version>,

stage="<stage>",

description="<description>"

)

Os valores aceitos para <stage> são: "Staging"|"staging", "Archived"|"archived", "Production"|"production", "None"|"none".

Use o modelo para inferência

Visualização

Esse recurso está em Public Preview.

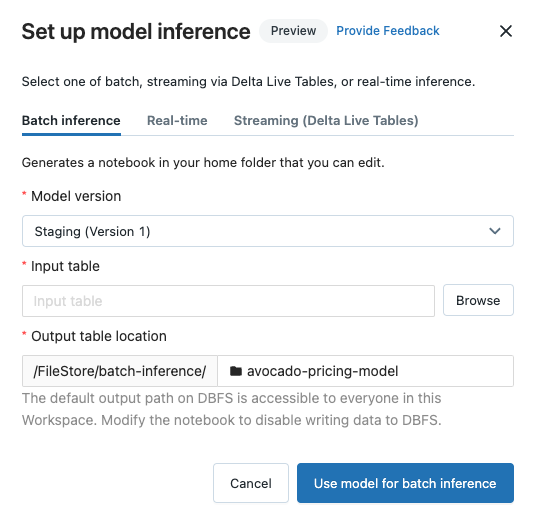

Depois que um modelo é registrado no site Workspace Model Registry, o senhor pode gerar automaticamente um Notebook para usar o modelo para inferência de lotes ou transmissão. Como alternativa, o senhor pode criar um endpoint para usar o modelo de tempo real servindo com o modelo servindo.

No canto superior direito da página do modelo registrado ou da página da versão do modelo, clique em. A caixa de diálogo Configurar inferência de modelo é exibida, permitindo que o senhor configure a inferência de lotes, transmissão ou tempo real.

A Anaconda Inc. atualizou seus termos de serviço para o canal anaconda.org. Com base nos novos termos de serviço, o senhor pode precisar de uma licença comercial se depender do empacotamento e da distribuição do Anaconda. Para obter mais informações, consulte as Perguntas frequentes sobre o Anaconda Commercial Edition. Seu uso de qualquer canal da Anaconda é regido pelos respectivos termos de serviço.

MLflow Os registros de modelos anteriores à v1.18 (Databricks Runtime 8.3 ML ou anterior) eram por registros default com o canal conda defaults (https://repo.anaconda.com/pkgs/) como uma dependência. Devido a essa alteração de licença, o site Databricks interrompeu o uso do canal defaults para registros de modelos que usam MLflow v1.18 e acima. Os registros do canal default agora são conda-forge, que apontam para a comunidade gerenciar https://conda-forge.org/.

Se o senhor fizer o logon de um modelo antes de MLflow v1.18 sem excluir o canal defaults do ambiente conda para o modelo, esse modelo poderá ter uma dependência do canal defaults que o senhor talvez não tenha pretendido.

Para confirmar manualmente se um modelo tem essa dependência, o senhor pode examinar o valor channel no arquivo conda.yaml que é empacotado com os modelos registrados. Por exemplo, o site conda.yaml de um modelo com uma dependência de canal defaults pode ter a seguinte aparência:

channels:

- defaults

dependencies:

- python=3.8.8

- pip

- pip:

- mlflow

- scikit-learn==0.23.2

- cloudpickle==1.6.0

name: mlflow-env

Como a Databricks não pode determinar se o uso do repositório do Anaconda para interagir com seus modelos é permitido em seu relacionamento com o Anaconda, a Databricks não está forçando seus clientes a fazer alterações. Se o seu uso do repositório Anaconda.com por meio do uso do Databricks for permitido de acordo com os termos do Anaconda, o senhor não precisará tomar nenhuma medida.

Se quiser alterar o canal usado no ambiente de um modelo, o senhor pode registrar novamente o modelo no espaço de trabalho registro de modelo com um novo conda.yaml. O senhor pode fazer isso especificando o canal no parâmetro conda_env de log_model().

Para obter mais informações sobre log_model() API, consulte a documentação MLflow da variante de modelo com a qual o senhor está trabalhando, por exemplo, os logs de scikit-learn.

Para obter mais informações sobre arquivos conda.yaml, consulte a documentaçãoMLflow.

Configurar a inferência de lotes

Quando o senhor segue essas etapas para criar um Notebook de inferência de lotes, o Notebook é salvo na pasta do usuário, na pasta Batch-Inference, em uma pasta com o nome do modelo. O senhor pode editar o Notebook conforme necessário.

-

Clique na inferência de lotes tab.

-

No menu suspenso Versão do modelo , selecione a versão do modelo a ser usada. Os dois primeiros itens no menu suspenso são a versão atual de produção e preparação do modelo (se existirem). Quando o senhor seleciona uma dessas opções, o Notebook usa automaticamente a versão Production ou Staging a partir do momento em que é executado. Não é necessário atualizar o Notebook à medida que o senhor continua a desenvolver o modelo.

-

Clique no botão Procurar ao lado da tabela de entrada . A caixa de diálogo Selecionar dados de entrada é exibida. Se necessário, o senhor pode alterar o clustering no menu suspenso de computação .

No espaço de trabalho habilitado para Unity Catalog, a caixa de diálogo Select input data (Selecionar dados de entrada) permite que o senhor selecione entre três níveis, <catalog-name>.<database-name>.<table-name>.

-

Selecione a tabela contendo os dados de entrada para o modelo e clique em Selecionar . O Notebook gerado importa automaticamente esses dados e os envia para o modelo. O senhor pode editar o Notebook gerado se os dados precisarem de alguma transformação antes de serem inseridos no modelo.

-

As previsões são salvas em uma pasta no diretório

dbfs:/FileStore/batch-inference. Em default, as previsões são salvas em uma pasta com o mesmo nome do modelo. Cada execução do Notebook gerado grava um novo arquivo nesse diretório com o registro de data e hora anexado ao nome. O senhor também pode optar por não incluir o carimbo de data/hora e sobrescrever o arquivo com a execução subsequente do Notebook; as instruções são fornecidas no Notebook gerado.Você pode alterar a pasta em que as previsões são salvas digitando um novo nome de pasta no campo Localização da tabela de saída ou clicando no ícone da pasta para navegar pelo diretório e selecionar uma pasta diferente.

Para salvar as previsões em um local em Unity Catalog, o senhor deve editar o Notebook. Para ver um exemplo de Notebook que mostra como treinar um modelo de aprendizado de máquina que usa dados em Unity Catalog e gravar os resultados de volta em Unity Catalog, consulte Aprendizado de máquina tutorial.

Configure a inferência de transmissão usando o pipeline declarativo LakeFlow Spark

Quando o senhor segue essas etapas para criar um Notebook de inferência de transmissão, o Notebook é salvo na sua pasta de usuário, na pasta DLT-Inference, em uma pasta com o nome do modelo. O senhor pode editar o Notebook conforme necessário.

-

Clique na tab transmissão (pipeline declarativo LakeFlow Spark ) .

-

No menu suspenso Versão do modelo , selecione a versão do modelo a ser usada. Os dois primeiros itens no menu suspenso são a versão atual de produção e preparação do modelo (se existirem). Quando o senhor seleciona uma dessas opções, o Notebook usa automaticamente a versão Production ou Staging a partir do momento em que é executado. Não é necessário atualizar o Notebook à medida que o senhor continua a desenvolver o modelo.

-

Clique no botão Procurar ao lado da tabela de entrada . A caixa de diálogo Selecionar dados de entrada é exibida. Se necessário, o senhor pode alterar o clustering no menu suspenso de computação .

No espaço de trabalho habilitado para Unity Catalog, a caixa de diálogo Select input data (Selecionar dados de entrada) permite que o senhor selecione entre três níveis, <catalog-name>.<database-name>.<table-name>.

-

Selecione a tabela contendo os dados de entrada para o modelo e clique em Selecionar . O Notebook gerado cria uma transformação de dados que usa a tabela de entrada como fonte e integra a MLflow PySpark inferência UDF para realizar previsões de modelos. O senhor pode editar o Notebook gerado se os dados exigirem transformações adicionais antes ou depois da aplicação do modelo.

-

Forneça o nome do pipeline declarativo LakeFlow Spark . O Notebook cria uma tabela dinâmica com o nome fornecido e a utiliza para armazenar as previsões do modelo. Você pode modificar o Notebook gerado para personalizar o dataset de destino conforme necessário - por exemplo: definir uma tabela de transmissão ao vivo como saída, adicionar informações de esquema ou restrições de qualidade de dados.

-

Em seguida, o senhor pode criar um novo pipeline com esse Notebook ou adicioná-lo a um pipeline existente como um Notebook biblioteca adicional.

Configurar a inferência em tempo real

O servindo modelo expõe seu MLflow modelo do aprendizado de máquina como um endpoint REST API escalável. Para criar um modelo de serviço endpoint, consulte Criar endpoint de modelo de serviço personalizado.

Forneça feedback

Esse recurso está em pré-visualização e gostaríamos de receber seu feedback. Para fornecer feedback, clique em Provide Feedback na caixa de diálogo Configurar inferência de modelo.

Compare as versões do modelo

Você pode comparar as versões do modelo no Workspace Model Registry.

- Na página do modelo registrado, selecione duas ou mais versões do modelo clicando na caixa de seleção à esquerda da versão do modelo.

- Clique em Comparar .

- A tela Comparing

<N>Versions (Comparando versões do ) é exibida, mostrando uma tabela que compara os parâmetros, o esquema e as métricas das versões do modelo selecionado. Na parte inferior da tela, o senhor pode selecionar o tipo de graficar (dispersão, contorno ou coordenadas paralelas) e os parâmetros ou métricas a serem graficados.

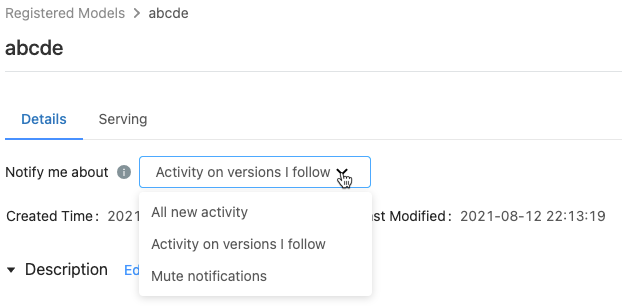

Controle as preferências de notificação

Você pode configurar o Workspace Model Registry para notificá-lo por e email sobre a atividade em modelos registrados e versões de modelo que você especificar.

Na página do modelo registrado, o menu Notifique-me sobre mostra três opções:

- Todas as novas atividades : Enviar notificações para email sobre todas as atividades em todas as versões desse modelo. Se o senhor criou o modelo registrado, essa configuração é a default.

- Atividade nas versões que eu sigo : Enviar notificações para email somente sobre as versões de modelos que o senhor segue. Com essa seleção, você recebe notificações para todas as versões de modelo que você segue; você não pode desativar as notificações para uma versão específica do modelo.

- Silenciar notificações : Não envie notificações para email sobre a atividade nesse modelo registrado.

Os seguintes eventos acionam uma notificação email:

- Criação de uma nova versão do modelo

- Solicitação de transição de estágio

- transição de estágio

- Novos comentários

Você se inscreve automaticamente para receber notificações de modelo quando realiza qualquer uma das seguintes ações:

- Comente sobre essa versão do modelo

- Faça a transição do estágio de uma versão do modelo

- Faça uma solicitação de transição para o estágio do modelo

Para ver se você está seguindo uma versão do modelo, consulte o campo Status do acompanhamento na página da versão do modelo ou a tabela de versões do modelo na página do modelo registrado.

Desativar todas as notificações do site email

Você pode desativar as notificações email na tab Configurações de Workspace Model Registry do menu Configurações do usuário:

- Clique no seu nome de usuário no canto superior direito do site Databricks workspace e selecione Settings (Configurações ) no menu suspenso.

- Na barra lateral Configurações , selecione Notificações .

- Desative as notificações do siteModel Registry email .

Um administrador do account pode desativar as notificações do email para toda a organização na página de configurações do administrador.

Número máximo de e-mails enviados

O Workspace Model Registry limita o número de emails enviados para cada usuário por dia por atividade. Por exemplo, se você receber 20 email em um dia sobre novas versões de modelo criadas para um modelo registrado, Workspace Model Registry enviará um email informando que o limite diário foi atingido e nenhum email adicional sobre esse evento será enviado até o dia seguinte .

Para aumentar o limite do número de e-mails permitidos, entre em contato com a equipe Databricks account .

Webhooks

Visualização

Esse recurso está em Public Preview.

Os webhooks permitem que o senhor ouça os eventos do Workspace Model Registry para que suas integrações possam acionar ações automaticamente. O senhor pode usar webhooks para automatizar e integrar seu aprendizado de máquina pipeline com as ferramentas CI/CD e o fluxo de trabalho existentes. Por exemplo, você pode acionar compilações de CI quando uma nova versão do modelo é criada ou notificar os membros da sua equipe pelo Slack sempre que uma transição de modelo para produção for solicitada.

anotar um modelo ou versão de modelo

Você pode fornecer informações sobre um modelo ou versão do modelo anotá-lo. Por exemplo, convém incluir uma visão geral do problema ou informações sobre a metodologia e o algoritmo usados.

anotar um modelo ou versão de modelo usando a interface do usuário

A interface do usuário da Databricks oferece várias maneiras de anotar modelos e versões de modelos. O senhor pode adicionar informações de texto usando uma descrição ou comentários e pode adicionar tags pesquisáveis key-value. As descrições e etiquetas estão disponíveis para modelos e versões de modelos; os comentários só estão disponíveis para versões de modelos.

- As descrições têm o objetivo de fornecer informações sobre o modelo.

- Os comentários fornecem uma maneira de manter uma discussão contínua sobre as atividades em uma versão do modelo.

- As tags permitem que você personalize os metadados do modelo para facilitar a localização de modelos específicos.

Adicionar ou atualizar a descrição de um modelo ou versão do modelo

-

Na página do modelo registrado ou da versão do modelo, clique em Editar ao lado de Descrição . Uma janela de edição é exibida.

-

Insira ou edite a descrição na janela de edição.

-

Clique em Salvar para salvar suas alterações ou em Cancelar para fechar a janela.

Se você inseriu uma descrição de uma versão do modelo, a descrição aparecerá na coluna Descrição na tabela na página do modelo registrado. A coluna exibe no máximo 32 caracteres ou uma linha de texto, o que for menor.

Adicionar comentários para uma versão do modelo

- Role para baixo na página da versão do modelo e clique na seta para baixo ao lado de Atividades .

- Digite seu comentário na janela de edição e clique em Adicionar comentário .

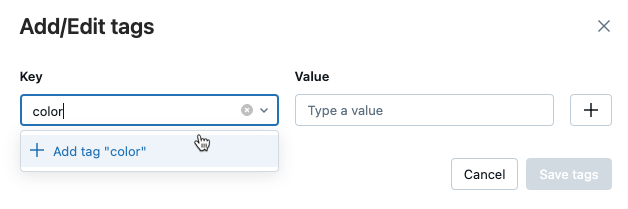

Adicionar tags para um modelo ou versão do modelo

-

Na página do modelo registrado ou da versão do modelo, clique

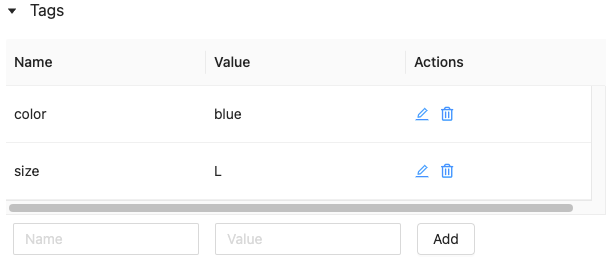

se ele ainda não estiver aberto. A tabela de tags é exibida.

-

Clique nos campos Name e Value e digite key e o valor da sua tag.

-

Clique em Adicionar .

Editar ou excluir tags para um modelo ou versão do modelo

Para editar ou excluir uma tag existente, use os ícones na coluna Ações .

anotar uma versão do modelo usando o API

Para atualizar a descrição de uma versão do modelo, use o método API do cliente MLflow update_model_version():

client = MlflowClient()

client.update_model_version(

name="<model-name>",

version=<model-version>,

description="<description>"

)

Para definir ou atualizar uma tag para um modelo registrado ou versão de modelo, use a API do MLflow Client set_registered_model_tag()) ou set_model_version_tag() method:

client = MlflowClient()

client.set_registered_model_tag()(

name="<model-name>",

key="<key-value>",

tag="<tag-value>"

)

client = MlflowClient()

client.set_model_version_tag()(

name="<model-name>",

version=<model-version>,

key="<key-value>",

tag="<tag-value>"

)

Renomear um modelo (somente API)

Para renomear um modelo registrado, use o método MLflow Client API rename_registered_model():

client=MlflowClient()

client.rename_registered_model("<model-name>", "<new-model-name>")

Você pode renomear um modelo registrado somente se ele não tiver versões ou se todas as versões estiverem no estágio Nenhuma ou Arquivado.

Procure um modelo

Você pode pesquisar modelos no Workspace Model Registry usando a interface do usuário ou a API.

Quando o senhor procura um modelo, são retornados apenas os modelos para os quais o senhor tem pelo menos permissões de CAN READ.

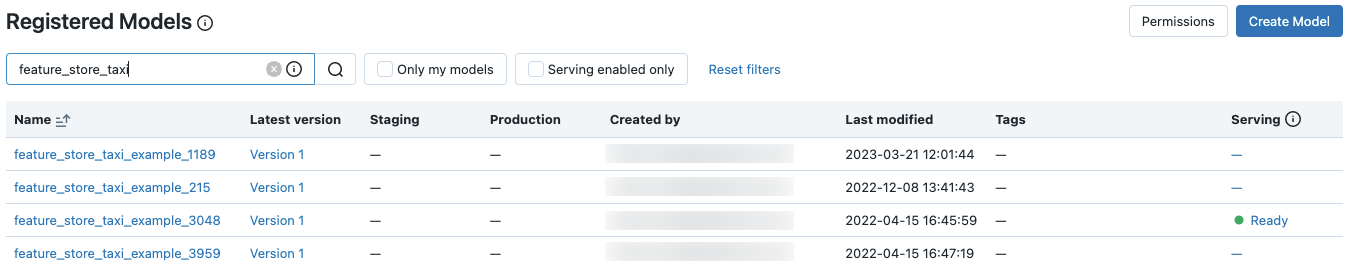

Pesquise um modelo usando a interface

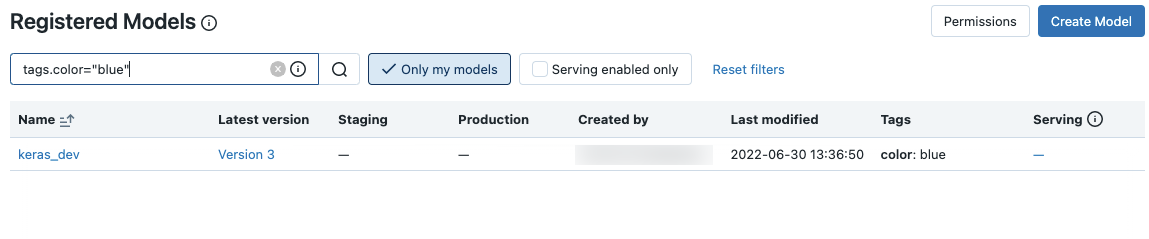

Para exibir os modelos registrados, clique em Modelos na barra lateral.

Para pesquisar um modelo específico, insira o texto na caixa de pesquisa. Você pode inserir o nome de um modelo ou qualquer parte do nome:

Você também pode pesquisar por tags. Insira as tags neste formato: tags.<key>=<value>. Para pesquisar várias tags, use o operador AND.

O senhor pode pesquisar tanto o nome do modelo quanto as tags usando a sintaxe de pesquisa do MLflow. Por exemplo:

![]()

Pesquisar um modelo usando a API

Você pode pesquisar modelos registrados no Workspace Model Registry com o método search_registered_models() MLflow .

Se você definiu tags em seus modelos, também pode pesquisar por essas tags com search_registered_models().

import mlflow

from pprint import pprint

print(f"Find registered models with a specific tag value")

for m in mlflow.search_registered_models(f"tags.`<key-value>`='<tag-value>'"):

pprint(dict(m), indent=4)

Você também pode pesquisar um nome de modelo específico e listar os detalhes da sua versão usando o método `search_model_versions()` do MLflow:

import mlflow

from pprint import pprint

[pprint(mv) for mv in mlflow.search_model_versions("name='<model-name>'")]

Isso gera:

{ 'creation_timestamp': 1582671933246,

'current_stage': 'Production',

'description': 'A random forest model containing 100 decision trees '

'trained in scikit-learn',

'last_updated_timestamp': 1582671960712,

'name': 'sk-learn-random-forest-reg-model',

'run_id': 'ae2cc01346de45f79a44a320aab1797b',

'source': './mlruns/0/ae2cc01346de45f79a44a320aab1797b/artifacts/sklearn-model',

'status': 'READY',

'status_message': None,

'user_id': None,

'version': 1 }

{ 'creation_timestamp': 1582671960628,

'current_stage': 'None',

'description': None,

'last_updated_timestamp': 1582671960628,

'name': 'sk-learn-random-forest-reg-model',

'run_id': 'd994f18d09c64c148e62a785052e6723',

'source': './mlruns/0/d994f18d09c64c148e62a785052e6723/artifacts/sklearn-model',

'status': 'READY',

'status_message': None,

'user_id': None,

'version': 2 }

Excluir um modelo ou versão do modelo

O senhor pode excluir um modelo usando a interface do usuário ou a API.

Excluir uma versão ou modelo do modelo usando a interface

Você não pode desfazer esta ação. Você pode fazer a transição de uma versão de modelo para o estágio Arquivado em vez de excluí-la do registro. Quando você exclui um modelo, todos os artefatos de modelo armazenados pelo Workspace Model Registry e todos os metadados associados ao modelo registrado são excluídos.

Você só pode excluir modelos e versões de modelos no estágio Nenhum ou Arquivado. Se um modelo registrado tiver versões no estágio de Preparação ou Produção, você deverá fazer a transição para o estágio Nenhum ou Arquivado antes de excluir o modelo.

Para excluir uma versão do modelo:

- Clique em

Modelos na barra lateral.

- Clique no nome de um modelo.

- Clique em uma versão do modelo.

- Clique no menu de kebab

no canto superior direito da tela e selecione Excluir no menu suspenso.

Para excluir um modelo:

- Clique em

Modelos na barra lateral.

- Clique no nome de um modelo.

- Clique no menu de kebab

no canto superior direito da tela e selecione Excluir no menu suspenso.

Excluir uma versão do modelo ou um modelo usando a API

Você não pode desfazer esta ação. Você pode fazer a transição de uma versão de modelo para o estágio Arquivado em vez de excluí-la do registro. Quando você exclui um modelo, todos os artefatos de modelo armazenados pelo Workspace Model Registry e todos os metadados associados ao modelo registrado são excluídos.

Você só pode excluir modelos e versões de modelos no estágio Nenhum ou Arquivado. Se um modelo registrado tiver versões no estágio de Preparação ou Produção, você deverá fazer a transição para o estágio Nenhum ou Arquivado antes de excluir o modelo.

Excluir uma versão do modelo

Para excluir uma versão do modelo, use o método delete_model_version() da API do cliente MLflow:

# Delete versions 1,2, and 3 of the model

client = MlflowClient()

versions=[1, 2, 3]

for version in versions:

client.delete_model_version(name="<model-name>", version=version)

Excluir um modelo

Para excluir um modelo, use o método MLflow Client API delete_registered_model():

client = MlflowClient()

client.delete_registered_model(name="<model-name>")

Compartilhe modelos em todo o espaço de trabalho

Databricks recomenda o uso de Models in Unity Catalog para compartilhar modelos entre espaços de trabalho. Unity Catalog oferece suporte imediato para acesso ao modeloworkspace, governança e registro de auditoria.

No entanto, se estiver usando o workspace registro de modelo, o senhor também pode compartilhar modelos em vários espaços de trabalho com algumas configurações. Por exemplo, o senhor pode desenvolver e log um modelo em seu próprio workspace e depois acessá-lo de outro workspace usando um registro de modelo de espaço de trabalho remoto. Isso é útil quando várias equipes compartilham o acesso aos modelos. O senhor pode criar vários espaços de trabalho e usar e gerenciar modelos entre esses ambientes.

Copiar objetos MLflow entre espaços de trabalho

Para importar ou exportar objetos MLflow de ou para seu Databricks workspace, o senhor pode usar o projeto de código aberto orientado pela comunidade MLflow Export-Import para migrar MLflow experimentos, modelos e execução entre espaços de trabalho.

Com essas ferramentas, você pode:

- Compartilhe e colabore com outros data scientists no mesmo ou em outro servidor de acompanhamento. Por exemplo, o senhor pode clonar um experimento de outro usuário para o seu workspace.

- Copiar um modelo de um site workspace para outro, como de um site de desenvolvimento para um site de produção workspace.

- Copie os experimentos e a execução do MLflow do seu servidor de acompanhamento local para o Databricks workspace.

- Faça backup de experimentos e modelos de missão crítica em outro site Databricks workspace.

Exemplo

Este exemplo ilustra como usar o Workspace Model Registry para criar um aplicativo machine learning.