execução seu LakeFlow Empregos com serverless compute para fluxo de trabalho

serverless compute para fluxo de trabalho permite que o senhor execute seu trabalho sem configurar e implantar infraestrutura. Com o serverless compute, o senhor se concentra na implementação do pipeline de análise e processamento de dados e Databricks gerencia com eficiência o compute recurso, incluindo a otimização e o dimensionamento do compute para suas cargas de trabalho. autoscale e Photon são ativados automaticamente para o recurso compute que executa seu trabalho.

O serverless compute for fluxo de trabalho otimiza automática e continuamente a infraestrutura, como tipos de instância, memória e mecanismos de processamento, para garantir o melhor desempenho com base nos requisitos específicos de processamento de suas cargas de trabalho.

Databricks atualiza automaticamente a versão do Databricks Runtime para oferecer suporte a aprimoramentos e atualizações da plataforma, garantindo a estabilidade do seu trabalho. Para ver a versão atual do Databricks Runtime usada pelo serverless compute para fluxo de trabalho, consulte serverless compute notas sobre a versão.

Como a permissão de criação de clustering não é necessária, todos os usuários do workspace podem usar o serverless compute para executar seu fluxo de trabalho.

Este artigo descreve o uso da UI LakeFlow Jobs para criar e executar trabalhos que usam serverless compute. O senhor também pode automatizar a criação e a execução de trabalhos que usam serverless compute com os Jobs API, Databricks ativo Bundles e o Databricks SDK para Python.

- Para saber mais sobre como usar o Jobs API para criar e executar trabalhos que usam serverless compute, consulte Jobs na referência REST API .

- Para saber mais sobre como usar Databricks ativo Bundles para criar e executar trabalhos que usam serverless compute, consulte Desenvolver um trabalho com Databricks ativo Bundles.

- Para saber mais sobre como usar o Databricks SDK para Python para criar e executar trabalhos que usam serverless compute, consulte Databricks SDK para Python.

Requisitos

- Seu Databricks workspace deve ter o Unity Catalog ativado.

- Como o serverless compute para fluxo de trabalho usa o modo de acesso padrão, suas cargas de trabalho devem suportar esse modo de acesso.

- Seu Databricks workspace deve estar em uma região compatível com o serverless compute. Veja recurso com disponibilidade regional limitada.

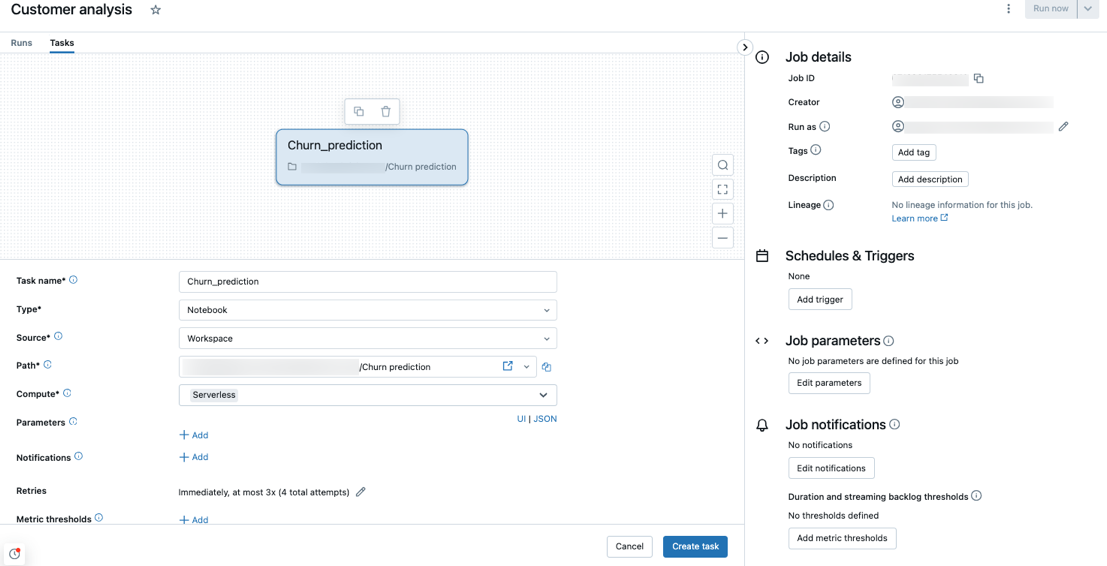

Criar um trabalho usando serverless compute

Como o serverless compute para o fluxo de trabalho garante o provisionamento de recursos suficientes para a execução de suas cargas de trabalho, o senhor pode ter um aumento no startup tempo ao executar um trabalho que exija grandes quantidades de memória ou inclua muitas tarefas.

compute sem servidor é suportada pelos tipos de tarefa Notebook, script Python , dbt, Python wheel e JAR . Por default, o tipo de compute selecionado ao criar um novo Job e adicionar um desses tipos de tarefa compatíveis é serverless compute .

Beta

O uso de compute serverless para tarefas JAR está em versão beta.

Databricks recomenda o uso do site serverless compute para todas as tarefas de trabalho. O senhor também pode especificar diferentes tipos de compute para tarefa em um trabalho, o que pode ser necessário se um tipo de tarefa não for suportado pelo serverless compute para fluxo de trabalho.

Para gerenciar as conexões de rede de saída do seu trabalho, consulte O que é o controle de saída serverless?

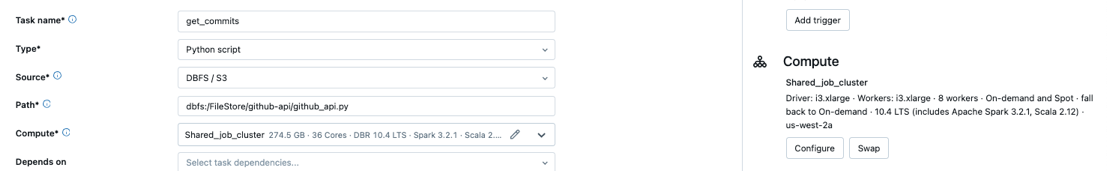

Configurar um trabalho existente para usar o site serverless compute

O senhor pode mudar um trabalho existente para usar o site serverless compute para os tipos de tarefa suportados ao editar o trabalho. Para mudar para serverless compute, o senhor pode:

- No painel lateral Job details , clique em swap em compute , clique em New , insira ou atualize as configurações e clique em Update .

- Clique em

no menu suspenso de computação e selecione serverless .

Programar um Notebook usando serverless compute

Além de usar o Jobs UI para criar e programar um trabalho usando serverless compute, o senhor pode criar e executar um trabalho que use serverless compute diretamente de um notebook Databricks. Consulte Criar e gerenciar o trabalho agendado do Notebook.

Selecione uma política de orçamento serverless para seu uso serverless

Visualização

Esse recurso está em Public Preview.

As políticas de orçamento sem servidor permitem que sua organização aplique tags personalizadas no uso do serverless para atribuição de faturamento granular.

Se o seu workspace usa políticas de orçamento serverless para atribuir o uso do serverless, o senhor pode selecionar a política de orçamento serverless do seu trabalho usando a configuração Budget policy (Política de orçamento ) na UI de detalhes do trabalho. Se o senhor estiver atribuído a apenas uma política de orçamento serverless, essa política será automaticamente selecionada para o seu novo trabalho.

Após a atribuição de uma política de orçamento do serverless ao senhor, os trabalhos existentes não serão automaticamente marcados com a sua política. O senhor deve atualizar manualmente os trabalhos existentes se quiser anexar uma política a eles.

Para saber mais sobre as políticas orçamentárias do site serverless, consulte Uso de atributos com políticas orçamentárias do site serverless.

Selecione um modo de desempenho

serverless O senhor pode escolher a velocidade de execução do seu trabalho usando a configuração de desempenho otimizado na página de detalhes do trabalho.

-

Quando o desempenho otimizado está desabilitado, o trabalho usa o modo de desempenho padrão. Este modo usa menos compute para reduzir custos, tornando-o adequado para cargas de trabalho que podem tolerar latência startup um pouco maior, de 4 a 6 minutos, dependendo da disponibilidade compute e do programa otimizado.

-

Quando o desempenho otimizado está ativado, o trabalho começa e é executado mais rapidamente. Esse modo foi projetado para cargas de trabalho urgentes.

Ambos os modos usam o mesmo SKU, mas o modo de desempenho padrão consome menos DBUs, refletindo menor uso compute .

Para definir a configuração de desempenho otimizado na UI, um trabalho deve ter pelo menos uma serverless tarefa. Essa configuração afeta apenas a tarefa serverless dentro do trabalho.

O modo de desempenho padrão não é compatível com a execução única criada usando o site runs/submit endpoint.

Definir os parâmetros de configuração do Spark

Para automatizar a configuração de Spark em serverless compute, Databricks permite definir apenas parâmetros específicos de configuração de Spark. Para obter a lista de parâmetros permitidos, consulte Parâmetros de configuração compatíveis com o Spark.

Você só pode definir os parâmetros de configuração do Spark no nível da sessão. Para isso, defina-os em um Notebook e adicione o Notebook a uma tarefa incluída no mesmo Job que utiliza os parâmetros. Consulte Definir propriedades de configuração do Spark no Databricks.

Configurar ambientes e dependências

Para saber como instalar o biblioteca e as dependências usando serverless compute, consulte Configurar o ambiente serverless.

Configurar memória alta para a tarefa Notebook

Visualização

Esse recurso está em Public Preview.

O senhor pode configurar a tarefa Notebook para usar um tamanho de memória maior. Para fazer isso, defina a configuração de Memória no painel lateral do Ambiente do Notebook. Consulte Usar memória alta serverless compute .

A memória alta só está disponível para os tipos de tarefa Notebook.

Configure serverless compute auto-optimization para não permitir novas tentativas

serverless compute for fluxo de trabalho auto-optimization otimiza automaticamente o compute usado para executar seu trabalho e tenta novamente as tarefas que falharam. A otimização automática é ativada pelo site default, e o Databricks recomenda deixá-la ativada para garantir que as cargas de trabalho críticas sejam executadas com êxito pelo menos uma vez. No entanto, se o senhor tiver cargas de trabalho que devem ser executadas no máximo uma vez, por exemplo, trabalhos que não são idempotentes, poderá desativar a otimização automática ao adicionar ou editar uma tarefa:

- Ao lado de Tentativas , clique em Adicionar (ou

se já existir uma política de repetição).

- Na caixa de diálogo Retry Policy (Política de repetição ), desmarque a opção Enable serverless auto-optimization (pode incluir tentativas adicionais) .

- Clique em Confirmar .

- Se estiver adicionando uma tarefa, clique em Create task (Criar tarefa ). Se estiver editando uma tarefa, clique em Save task (Salvar tarefa ).

Monitorar o custo do trabalho que usa o site serverless compute para fluxo de trabalho

O senhor pode monitorar o custo do trabalho que usa o site serverless compute para fluxo de trabalho consultando a tabela do sistema de uso faturável. Essa tabela é atualizada para incluir atributos de usuário e carga de trabalho sobre os custos do serverless. Consulte a referência da tabela do sistema de uso faturável.

Para obter informações sobre os preços atuais e quaisquer promoções, consulte a página de preços do fluxo de trabalho.

visualizar detalhes da consulta para execução do trabalho

O senhor pode view informações detalhadas sobre o tempo de execução de suas declarações Spark, como métricas e planos de consulta.

Para acessar os detalhes da consulta na Job UI, siga as etapas abaixo:

-

Na barra lateral do site Databricks workspace, clique em Jobs & pipeline .

-

Opcionalmente, selecione o filtro Trabalhos .

-

Clique no nome do trabalho que o senhor deseja view.

-

Clique na execução específica que o senhor deseja view.

-

Clique em Timeline (Linha do tempo ) para view a execução como uma linha do tempo, dividida em tarefas individuais.

-

Clique na seta ao lado do nome da tarefa para mostrar as instruções de consulta e seus tempos de execução.

-

Clique em uma declaração para abrir o painel de detalhes da consulta . Consulte Exibir detalhes da consulta para saber mais sobre as informações disponíveis nesse painel.

Para view a história da consulta para uma tarefa:

- Na seção de computação do painel lateral da tarefa execução , clique em Query história .

- O senhor é redirecionado para o site Query History, pré-filtrado com base no ID de execução da tarefa em que estava.

Para obter informações sobre como usar query história, consulte Acessar query história para pipeline e Query história.

Limitações

Para obter uma lista de serverless compute limitações de fluxo de trabalho, consulte as limitações do serverless compute em serverless compute notas sobre a versão.